入门¶

OpenGL可以被看作是一个大的状态机。API中的一些函数会根据当前OpenGL的状态的不同,而产生不同的效果,这些函数被称为状态函数。

OpenGL的工作流:

创建对象->绑定对象到上下文(Bind Gen出来的Object到OpenGL上下文的内置属性)->设置已绑定对象的选项->解绑对象

PS:解绑对象只是让对象和上下文之间断开联系。实际上选项已经改变,与解绑无关。当要获取之前那个对象的信息时,只需要重新绑定那个上下文变量就行了。比如说我们有一些作为3D模型数据(一栋房子或一个人物)的容器对象,在我们想绘制其中任何一个模型的时候,只需绑定一个包含对应模型数据的对象就可以了。拥有数个这样的对象允许我们指定多个模型,在想画其中任何一个的时候,直接将对应的对象绑定上去,便不需要再重复设置选项了。

// 创建对象 unsigned int objectId = 0; glGenObject(1, &objectId); // 绑定对象至上下文 glBindObject(GL_WINDOW_TARGET, objectId); // 设置当前绑定到 GL_WINDOW_TARGET 的对象的一些选项 glSetObjectOption(GL_WINDOW_TARGET, GL_OPTION_WINDOW_WIDTH, 800); glSetObjectOption(GL_WINDOW_TARGET, GL_OPTION_WINDOW_HEIGHT, 600); // 将上下文对象设回默认 glBindObject(GL_WINDOW_TARGET, 0);

环境配置¶

GLFW¶

下载源代码,使用Clion打开源代码根目录作为项目。

点击构建-构建项目,完成后在cmake-build-output/src文件夹下找到glfw3.dll文件。

新建空项目,新建libs和include文件夹,将GLFW源代码中include文件夹的内容拖入新include文件夹,将编译完成的glfw3.dll拖入libs文件夹。同时,也要把glfw3.dll拖入cmake-build-output文件夹下

修改CMakeList.txt内容如下:

cmake_minimum_required(VERSION 3.28)

project(LearnOpenGL) # 定义项目名

set(CMAKE_CXX_STANDARD 17)

add_executable(LearnOpenGL main.cpp) # 这步必须放在链接操作之前

INCLUDE_DIRECTORIES(include) # include文件所在路径

link_directories(libs) # libs文件所在路径

target_link_libraries(LearnOpenGL libs/glfw3.dll) # dll文件所在路径

重新加载CMake即可。可新建cpp文件,输入#include <GLFW\glfw3.h>,若未报错则链接成功。

GLAD¶

打开http://glad.dav1d.de/,按照以下规则配置:

Language:C/C++

Specification:OpenGL

API-gl:3.3 and newer

Opentions - Generate a loader:打勾

点击Generate按钮,下载glad.zip,解压,将include内的文件拖动到工程的include文件里,glad.c则放到工程根目录。使用#include <glad\glad.h>验证是否配置成功。

范例工程¶

头文件¶

#include <glad/glad.h>

#include <GLFW/glfw3.h>

注意:glad头文件必须在GLFW之前include

代码¶

#include <iostream>

#include <glad/glad.h>

#include <GLFW/glfw3.h>

using namespace std;

//处理键盘输入,当用户按下ESC键时,提醒程序要退出

void processInput(GLFWwindow *window)

{

//glfwGetKey函数用于检查一个键是否正在被按下

if(glfwGetKey(window, GLFW_KEY_ESCAPE) == GLFW_PRESS)

glfwSetWindowShouldClose(window, true);

}

//回调函数,使视口范围随窗口大小变化。

void framebuffer_size_callback(GLFWwindow* window, int width, int height)

{

glViewport(0, 0, width, height);

}

int main(){

// -----------glfw初始化与窗口创建-----------

// 初始化glfw组件

glfwInit();

//指定opengl版本为3.3

glfwWindowHint(GLFW_CONTEXT_VERSION_MAJOR, 3);

glfwWindowHint(GLFW_CONTEXT_VERSION_MINOR, 3);

//告诉glfw我们使用的是核心模式

//核心模式意味着我们只能使用OpenGL功能的核心功能子集

glfwWindowHint(GLFW_OPENGL_PROFILE,GLFW_OPENGL_CORE_PROFILE);

//创建glfw窗口

//第一个参数是窗口的宽度,第二个是高度,第三个是窗口的标题,第四个参数指定窗口是否共享资源,第五个参数是共享资源的窗口

//共享资源指的是多个窗口可以共享同一个上下文

GLFWwindow* window = glfwCreateWindow(800, 600, "LearnOpenGL", NULL, NULL);

//检查窗口是否创建成功

if (window == NULL)

{

cout << "Failed to create GLFW window" << endl;

//销毁glfw

glfwTerminate();

return -1;

}

//通知glfw将我们窗口的上下文设置为当前线程的主上下文

glfwMakeContextCurrent(window);

// -----------GLAD加载所有OpenGL函数指针-----------

if(!gladLoadGLLoader((GLADloadproc)glfwGetProcAddress)){

cout << "Failed to initialize GLAD" << endl;

return -1;

}

//先前只是生成了窗口的大小,但窗口大小与实际渲染区域无关。因此,我们需要定义渲染区域的大小,即视口(Viewport)。

//视口定义了窗口中可以渲染的区域,将其设置为窗口的维度

//前两个参数代表渲染区域左下角在GLFW窗口的坐标。第三个和第四个参数是渲染区域的宽度和高度(像素)

//注意,这里并没有传入window,所以glViewport是个状态使用函数。

glViewport(0, 0, 800, 600);

//为了让窗口被改变时,视口也能相应改变,我们需要注册一个窗口大小的回调函数

//glfwSetFramebufferSizeCallback函数接受一个窗口,一个函数指针,当窗口大小改变时调用这个函数

glfwSetFramebufferSizeCallback(window,framebuffer_size_callback);

// -----------渲染循环-----------

//当窗口被要求关闭时,glfwWindowShouldClose函数返回true

while(!glfwWindowShouldClose(window)){

// 清除颜色缓冲

// glClearColor用来设置清空屏幕所用的颜色

glClearColor(0.2f, 0.3f, 0.3f, 1.0f);

// 清除颜色缓冲。除此之外还有GL_DEPTH_BUFFER_BIT,GL_STENCIL_BUFFER_BIT,分别用于清除深度缓冲、模板缓冲

// glClearColor是状态设置函数,而glClear是状态使用函数

glClear(GL_COLOR_BUFFER_BIT);

// 调用输入函数,处理键盘输入

processInput(window);

//

// 这里放渲染指令...

//

// 交换缓冲区(双缓冲区的实现, 用于避免图像闪烁)

glfwSwapBuffers(window);

// 处理事件,比如键盘和鼠标事件,随后更新窗口状态并调用回调函数

glfwPollEvents();

}

// -----------清理资源-----------

glfwDestroyWindow(window);

glfwTerminate();

return 0;

}

通常的OpenGL范例程序:

初始化GLFW->设置GLFW信息,如OpenGL版本号->生成窗口->设置线程上下文->使用GLAD获取GL函数->定义渲染视口大小->注册各类回调函数->进入渲染循环->销毁资源

渲染循环内部:

清空缓存->处理输入->进行渲染操作(在后缓冲上绘制)->检查并调用事件,交换缓冲(使后缓冲的内容显示到画面上)

GLFW函数可分为两类:状态设置函数和状态使用函数。前者用于设置状态量,后者用于借助已经设置完毕的状态来改变程序行为。

对象绘制¶

基础¶

顶点数组对象:Vertex Array Object,VAO

顶点缓冲对象:Vertex Buffer Object,VBO

元素缓冲对象:Element Buffer Object,EBO 或 索引缓冲对象 Index Buffer Object,IBO

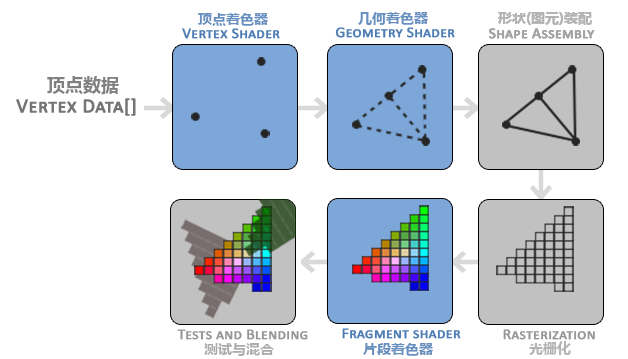

图形渲染管线可以被分为两个部分:

- 第一部分负责将3D坐标转换为2D坐标

- 第二部分负责将2D坐标转换为有颜色的,实际屏幕上的像素。

2D坐标与像素不同。像素是2D坐标的近似值,受分辨率影响。

着色器是运行在GPU上的处理程序。每个小核心负责一个着色器的计算。

Vertex Shader、Geometry Shader和Fragment Shader可以由开发者自定义。

Vertex Shader把单独的顶点作为输入,将局部坐标系下的顶点坐标转换到标准化设备坐标(NDC),同时对顶点属性(Vertex Attribute)进行基本处理。

经Vertex Shader处理过的坐标必定是NDC,范围为[-1, 1]

Geometry Shader把一个图元(包括点、线、三角形三种类型)的顶点作为输入,根据需要处理这些顶点,也可以生成新的顶点,用于构建新的形状。

这个过程可选。

Shape Assembly将前阶段的所有顶点作为输入,并将其装配为指定图元的形状。

Rasterization把图元映射为屏幕上的像素,生成Fragment, 并剔除View以外的所有像素。

glViewport函数定义了视口信息。视口变换(Viewport Transform)将NDC变换为屏幕空间坐标。

屏幕空间坐标被变换为Fragment,输入到Fragment Shader中。

Fragment Shader用于计算一个像素的最终颜色。该阶段包含3D场景的数据,如光照、阴影等。

Test and Blending阶段,首先检测所有像素的深度值、模板值,用于判断像素是正面还是背面,并据此决定是否丢弃。随后,根据像素的alpha值,进行blend操作。

顶点输入¶

顶点数据首先被送到顶点着色器。这些数据以顶点缓冲对象(Vertex Buffer Objects, VBO)的状态存储在GPU内存(即显存)中。

使用VBO的优点在于,可以一次发送一大批数据到GPU上,而非一个顶点传送一次。

CPU到GPU的传输速度较慢,所以要尽量减少传输次数,一次发送尽可能多的数据。

通过glGenBuffers(int count, unsigned int* VBO)函数生成VBO对象。生成完毕后,变量VBO将存储VBO实例的id。随后,进行绑定操作。

unsigned int VBO;

glGenBuffers(1, &VBO); //生成一个VBO对象,带有缓冲区id

glBindBuffer(GL_ARRAY_BUFFER, VBO); //将该对象绑定到GL上下文的GL_ARRAY_BUFFER目标

任何对象在生成以后都需要与GL上下文中的特定目标进行绑定,才能生效。

每个缓冲区目标都只能同时绑定一个对象。

GL_ARRAY_BUFFER存储的对象通常是:需要在CPU和GPU之间传输的顶点相关数据。

glBufferData(CONTEXT_TARGET, int data_len, float[] data, DRAW_FORM)用于向当前绑定的缓冲区存入用户定义数据。

float verticals[] = {

-0.5f, -0.5f, 0.0f,

0.5f, -0.5f, 0.0f,

0.0f, 0.5f, 0.0f

};

glBufferData(GL_ARRAY_BUFFER, sizeof(verticals),verticals, GL_STATIC_DRAW);

DRAW_FORM参数用于指定显卡如何管理存入的数据。

- GL_STATIC_DRAW:存入的数据几乎不会发生变化

- GL_DYNAMIC_DRAW:存入的数据时常会有发生变化

- GL_STREAM_DRAW:存入的数据每时每刻都在变化

至此,顶点已完成了输入,此刻的顶点数据以VBO的形式存储在显存中。

顶点着色器¶

#version 330 core //定义版本号和PROFILE模式

//定义一个名为aPos的输入变量,其位置索引为0,类型为vec3。

layout (location = 0) in vec3 aPos;

void main()

{

//将输入的顶点位置转换为4维向量(齐次坐标),并赋值给内建变量gl_Position,该变量表示顶点着色器的输出位置。

gl_Position = vec4(aPos, 1.0);

}

location变量用于绑定顶点属性的特定位置索引。一般而言,顶点属性都是用float类型存储的。而存放顶点数据的vertical数组又是一维而非二维的。因此,可能出现前N个数据里,数据[0,N-M]是位置数据,而[N-M+1,N]是颜色数据。通过设置不同的location变量,可以解明顶点数据的具体含义。

gl_Position的值将会成为顶点着色器的输出。

在实际的顶点着色器中,往往还需要经过坐标变换到NDC的过程。

C++源码文件无法直接嵌入GLSL代码。所以需要在运行时动态编译。

//顶点着色器源码

const char *vertexShaderSource = "#version 330 core\n"

"layout (location = 0) in vec3 aPos;\n"

"void main()\n"

"{\n"

" gl_Position = vec4(aPos.x, aPos.y, aPos.z, 1.0);\n"

"}\0";

//用于保存着色器对象ID引用的无符号整数

unsigned int vertexShader;

//使用glCreateShader函数创建指定类型的着色器对象

//由于同种类型的着色器只能生成一个,所以可以直接赋值而非传入地址

vertexShader = glCreateShader(GL_VERTEX_SHADER);

//对于glShaderSource,其参数含义分别为:着色器对象、源码字符串数量、源码字符串首地址、包含每个字符串长度的整数数组。该函数是把“源码字符串”绑定到“着色器对象”的操作。

glShaderSource(vertexShader, 1, &vertexShaderSource, NULL);

//进行编译

glCompileShader(vertexShader);

通过glGetShaderiv函数可以检测编译是否成功。

int success; //是否成功编译的flag

char infoLog[512]; //错误信息字符数组

//glGetShaderiv用于获取着色器信息

//第二个参数可替换为以下选项:

//GL_SHADER_TYPE:获取着色器类型

//..待补充

glGetShaderiv(vertexShader, GL_COMPILE_STATUS, &success); //获取编译结果

if(!success)

{ //若未编译成功

glGetShaderInfoLog(vertexShader, 512, NULL, infoLog); //获取编译错误信息,512代表infoLog数组大小

std::cout << "ERROR::SHADER::VERTEX::COMPILATION_FAILED\n" << infoLog << std::endl; //打印

}

片元着色器¶

片元着色器用于计算像素最后的颜色输出。

#version 330 core

out vec4 FragColor; // 片元着色器允许用户自定义输出变量

void main()

{

FragColor = vec4(1.0f, 0.5f, 0.2f, 1.0f); //橘黄色

}

随后进行编译。

const char* fragmentShaderSource = "#version 330 core\n"

"out vec4 FragColor;\n"

"void main()\n"

"{\n"

"FragColor = vec4(1.0f, 0.5f, 0.2f, 1.0f);\n"

"}\n";

unsigned int fragmentShader;

fragmentShader = glCreateShader(GL_FRAGMENT_SHADER);

glShaderSource(fragmentShader, 1, &fragmentShaderSource, NULL);

glCompileShader(fragmentShader);

着色器程序¶

完成着色器编译后,还需要编写着色器程序。整个渲染管线就像一个链表,着色器是其中的一个个节点,而着色器程序负责把这些节点连接(Link)起来,并负责数据的输入输出。

当链接着色器至一个程序的时候,它会把每个着色器的输出链接到下个着色器的输入。当输出和输入不匹配的时候,你会得到一个连接错误。

unsigned int shaderProgram; //句柄

shaderProgram = glCreateProgram();

//注意Attach操作的顺序

glAttachShader(shaderProgram, vertexShader);

glAttachShader(shaderProgram, fragmentShader);

//完成Attach以后,进行Link操作。

glLinkProgram(shaderProgram);

借助glGetProgramiv函数,可以判断链接是否出错。

glGetProgramiv(shaderProgram, GL_LINK_STATUS, &success);

if(!success) {

glGetProgramInfoLog(shaderProgram, 512, NULL, infoLog);

...

}

链接完毕后,使用glUseProgram函数激活着色器程序对象,同时,删除先前定义的着色器,以释放内存。

glUseProgram(shaderProgram);

glDeleteShader(vertexShader);

glDeleteShader(fragmentShader);

完成这一系列操作以后,我们完成了以下内容:

- 发送顶点数据,让其以VBO的状态存储在显存。

- 编写了Vertex Shader和Fragment Shader,并指示GPU该如何使用这些着色器处理顶点数据。

链接顶点属性¶

我们输入的verticals数组是一个一维float数组。在这个数组里,每3个元素代表着一个顶点的位置数据。但OpenGL不知道,所以我们要告诉OpenGL,数组的哪些位置代表着哪个顶点的什么属性。

//指定解析顶点数据的方式

//第一个参数指定我们要配置的顶点属性,即着色器中的location。位置信息是一个location,颜色信息就是另一个location

//第二个参数指定顶点数据的大小,也就是每个属性的维度数。位置数据是一个三维向量,所以输入3

//第三个参数指定数据的类型

//第四个参数指定是否归一化,映射到0-1(或-1到1,对于有符号数来说。)

//第五个参数指定步长,即:这个属性第二次出现的地方到整个数组0位置之间有多少字节。对于单一属性数组,可设置为0

//第六个参数表示数据在缓冲区相对于起始位置的偏移量。如:位置信息包含3字节,紧随其后的是颜色信息。那么对于位置信息,这个参数就是(void*)0,对于颜色信息就是(void*)3

glVertexAttribPointer(0, 3, GL_FLOAT, GL_FALSE, 3 * sizeof(float), (void*)0);

//设置完成后,启用顶点属性

glEnableVertexAttribArray(0);

//随后启用着色器程序

glUseProgram(shaderProgram);

顶点数组对象¶

所以,每次绘制一个物体,我们都必须经历以下步骤:

- 生成VBO对象

- 绑定VBO对象到GL_ARRAY_BUFFER

- 将顶点数据(float数组)传入GL_ARRAY_BUFFER

- 设置顶点属性指针

- 启用顶点属性

- 使用着色器程序

- 绘制物体

非常繁琐。为了减少工作量,我们引入顶点数组对象(Vertex Array Object,VAO)的概念。

一个顶点数组对象会储存以下这些内容:

- glEnableVertexAttribArray和glDisableVertexAttribArray的调用。

- 通过glVertexAttribPointer设置的顶点属性配置。

- 通过glVertexAttribPointer调用与顶点属性关联的顶点缓冲对象。

一般,完整的渲染代码可以表示为:

// ..:: 初始化代码(只运行一次 (除非你的物体频繁改变)) :: ..

// 生成VAO、VBO对象....

unsigned int VAO;

glGenVertexArrays(1, &VAO);

unsigned int VBO;

glGenVertexArrays(1, &VBO);

// 1. 绑定VAO

glBindVertexArray(VAO);

// 2. 把顶点数组复制到缓冲中供OpenGL使用

glBindBuffer(GL_ARRAY_BUFFER, VBO);

glBufferData(GL_ARRAY_BUFFER, sizeof(vertices), vertices, GL_STATIC_DRAW);

// 3. 设置顶点属性指针

glVertexAttribPointer(0, 3, GL_FLOAT, GL_FALSE, 3 * sizeof(float), (void*)0);

glEnableVertexAttribArray(0);

// ..:: 绘制代码(渲染循环中) :: ..

// 4. 绘制物体

glUseProgram(shaderProgram);

glBindVertexArray(VAO);

someOpenGLFunctionThatDrawsOurTriangle();

绘制¶

glDrawArray函数使用当前激活的着色器和VAO(包含VBO信息)来绘制图元(点、线、三角)。

glUseProgram(shaderProgram);

glBindVertexArray(VAO);

// 第一个参数表示图元类型

// 第二个参数表示顶点数组起始索引

// 第三个表示绘制的顶点数量

glDrawArrays(GL_TRIANGLES, 0, 3);

完整代码¶

#include <iostream>

#include <glad/glad.h>

#include <GLFW/glfw3.h>

using namespace std;

//顶点数据

float verticals[] = {

-0.5f, -0.5f, 0.0f,

0.5f, -0.5f, 0.0f,

0.0f, 0.5f, 0.0f

};

//顶点着色器源码

const char* vertex_shader="#version 330 core\n"

"layout(location=0) in vec3 aPos;\n"

"void main()\n"

"{\n"

"gl_Position = vec4(aPos,1.0);"

"}\n";

//片段着色器源码

const char* fragment_shader="#version 330 core\n"

"out vec4 Fragcolor;\n"

"void main()\n"

"{\n"

"Fragcolor = vec4(1.0f, 0.5f, 0.2f, 1.0f);"

"}\n";

//输入处理函数

void process_input(GLFWwindow* window, int width, int height){

glViewport(0,0,width,height);

}

int main(){

//初始化glfw并配置版本和PROFILE模式

glfwInit();

glfwWindowHint(GLFW_CONTEXT_VERSION_MAJOR,3);

glfwWindowHint(GLFW_CONTEXT_VERSION_MINOR,3);

glfwWindowHint(GLFW_OPENGL_PROFILE,GLFW_OPENGL_CORE_PROFILE);

//创建glfw窗口

GLFWwindow* window = glfwCreateWindow(800,600,"LearnOpenGL",NULL,NULL);

//创建错误处理

if(window==NULL){

cout<<"Failed to create GLFW Window!"<<endl;

glfwTerminate();

return -1;

}

//将窗口上下文设置为当前线程上下文

glfwMakeContextCurrent(window);

//加载glad函数

if(!gladLoadGLLoader((GLADloadproc)glfwGetProcAddress)){

cout<<"Failed to load proc"<<endl;

return -1;

}

//定义视口大小

glViewport(0,0,800,600);

//配置窗口大小改变的回调函数,使得窗口改变时视口随之改变

glfwSetFramebufferSizeCallback(window,process_input);

//创建、绑定VBO对象

unsigned int VBO;

glGenBuffers(1,&VBO);

glBindBuffer(GL_ARRAY_BUFFER,VBO);

glBufferData(GL_ARRAY_BUFFER,sizeof(verticals),verticals,GL_STATIC_DRAW);

//创建、绑定VAO对象

unsigned int VAO;

glGenVertexArrays(1,&VAO);

glBindVertexArray(VAO);

//配置顶点属性指针,说明顶点数据与属性的对应关系

glVertexAttribPointer(0,3,GL_FLOAT,GL_FALSE,0,(void*)0);

//启用顶点属性

glEnableVertexAttribArray(0);

//创建顶点着色器

unsigned int vertex = glCreateShader(GL_VERTEX_SHADER);

//链接着色器对象与源代码

glShaderSource(vertex,1,&vertex_shader,NULL);

//编译着色器

glCompileShader(vertex);

int success; //是否成功编译的flag

char infoLog[512]; //错误信息字符数组

glGetShaderiv(vertex, GL_COMPILE_STATUS, &success); //获取编译结果

if(!success)

{ //若未编译成功

glGetShaderInfoLog(vertex, 512, NULL, infoLog); //获取编译错误信息,512代表infoLog数组大小

std::cout << "ERROR::SHADER::VERTEX::COMPILATION_FAILED\n" << infoLog << std::endl; //打印

}

//同上

unsigned int fragment = glCreateShader(GL_FRAGMENT_SHADER);

glShaderSource(fragment,1,&fragment_shader,NULL);

glCompileShader(fragment);

glGetShaderiv(fragment, GL_COMPILE_STATUS, &success); //获取编译结果

if(!success)

{ //若未编译成功

glGetShaderInfoLog(fragment, 512, NULL, infoLog); //获取编译错误信息,512代表infoLog数组大小

std::cout << "ERROR::SHADER::FRAGMENT::COMPILATION_FAILED\n" << infoLog << std::endl; //打印

}

//创建着色器程序

unsigned int shader_program = glCreateProgram();

//添加着色器“节点”,注意顺序

glAttachShader(shader_program,vertex);

glAttachShader(shader_program,fragment);

//完成链接操作

glLinkProgram(shader_program);

//激活着色器程序

glUseProgram(shader_program);

//删除着色器对象,释放内存

glDeleteShader(vertex);

glDeleteShader(fragment);

//渲染循环

while(!glfwWindowShouldClose(window)){

//设置清空颜色

glClearColor(0.2f,0.3f,0.3f,1.0f);

//清空上一帧

glClear(GL_COLOR_BUFFER_BIT);

//激活着色器程序

glUseProgram(shader_program);

//绑定VAO对象

glBindVertexArray(VAO);

//绘制三个顶点的三角形图元

glDrawArrays(GL_TRIANGLES,0,3);

//交换前后缓冲

glfwSwapBuffers(window);

//处理外部输入

glfwPollEvents();

}

}

元素缓冲对象¶

当图元存在共用顶点的情况时,传统的绘制方法会把共用的顶点绘制两次,导致额外开销。

为此,元素缓冲对象(Element Buffer Object, EBO)提供了一种方式,用于存储OpenGL用来决定要绘制哪些顶点的索引。

使用EBO时,顶点数据必须是不重复的顶点。

float vertices[] = {

0.5f, 0.5f, 0.0f, // 右上角

0.5f, -0.5f, 0.0f, // 右下角

-0.5f, -0.5f, 0.0f, // 左下角

-0.5f, 0.5f, 0.0f // 左上角

};

unsigned int indices[] = {

// 注意索引从0开始!

// 此例的索引(0,1,2,3)就是顶点数组vertices的下标,

// 这样可以由下标代表顶点组合成矩形

0, 1, 3, // 第一个三角形

1, 2, 3 // 第二个三角形

};

unsigned int EBO;

glGenBuffers(1, &EBO);

glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, EBO);

glBufferData(GL_ELEMENT_ARRAY_BUFFER, sizeof(indices), indices, GL_STATIC_DRAW);

//渲染循环内...

glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, EBO);

glDrawElements(GL_TRIANGLES, 6, GL_UNSIGNED_INT, 0); //注意,使用EBO时需要使用glDrawElements。其中,第四个参数表示EBO中的偏移量。

使用EBO的完整代码如下:

#include <iostream>

#include <glad/glad.h>

#include <GLFW/glfw3.h>

using namespace std;

float vertices[] = {

0.5f, 0.5f, 0.0f, // 右上角

0.5f, -0.5f, 0.0f, // 右下角

-0.5f, -0.5f, 0.0f, // 左下角

-0.5f, 0.5f, 0.0f // 左上角

};

unsigned int indices[] = {

0, 1, 3, // 第一个三角形

1, 2, 3 // 第二个三角形

};

//顶点着色器源码

const char* vertex_shader="#version 330 core\n"

"layout(location=0) in vec3 aPos;\n"

"void main()\n"

"{\n"

"gl_Position = vec4(aPos,1.0);"

"}\n";

//片段着色器源码

const char* fragment_shader="#version 330 core\n"

"out vec4 Fragcolor;\n"

"void main()\n"

"{\n"

"Fragcolor = vec4(1.0f, 0.5f, 0.2f, 1.0f);"

"}\n";

void process_input(GLFWwindow* window,int width, int height){

glViewport(0,0,width,height);

}

int main(){

glfwInit();

glfwWindowHint(GLFW_CONTEXT_VERSION_MAJOR,3);

glfwWindowHint(GLFW_CONTEXT_VERSION_MINOR,3);

glfwWindowHint(GLFW_OPENGL_PROFILE,GLFW_OPENGL_CORE_PROFILE);

GLFWwindow* window = glfwCreateWindow(800,600,"LearnOpenGL",NULL,NULL);

if(window==NULL){

cout<<"Failed to Create Window"<<endl;

glfwTerminate();

return -1;

}

glfwMakeContextCurrent(window);

if(!gladLoadGLLoader((GLADloadproc) glfwGetProcAddress)){

cout<<"Failed to Load GLAD proc"<<endl;

glfwTerminate();

return -1;

}

glViewport(0,0,800,600);

glfwSetFramebufferSizeCallback(window,process_input);

//编译着色器

unsigned int vertex = glCreateShader(GL_VERTEX_SHADER);

glShaderSource(vertex,1,&vertex_shader,NULL);

glCompileShader(vertex);

int success;

char info[512];

glGetShaderiv(vertex,GL_COMPILE_STATUS,&success);

if(!success){

glad_glGetShaderInfoLog(vertex,512,NULL,info);

cout<<"VERTEX SHADER COMPILE ERROR:"<<info<<endl;

}

unsigned int fragment = glCreateShader(GL_FRAGMENT_SHADER);

glShaderSource(fragment,1,&fragment_shader,NULL);

glCompileShader(fragment);

glGetShaderiv(fragment,GL_COMPILE_STATUS,&success);

if(!success){

glad_glGetShaderInfoLog(fragment,512,NULL,info);

cout<<"FRAGMENT SHADER COMPILE ERROR:"<<info<<endl;

}

unsigned int shader_program = glCreateProgram();

glAttachShader(shader_program,vertex);

glAttachShader(shader_program,fragment);

glLinkProgram(shader_program);

glGetProgramiv(shader_program, GL_LINK_STATUS, &success);

if (!success) {

glGetProgramInfoLog(shader_program, 512, NULL, info);

std::cout << "ERROR::SHADER::PROGRAM::LINKING_FAILED\n" << info << std::endl;

}

glDeleteShader(vertex);

glDeleteShader(fragment);

//定义VAO、VBO、EBO

unsigned int VBO;

glGenBuffers(1,&VBO);

glBindBuffer(GL_ARRAY_BUFFER,VBO);

glBufferData(GL_ARRAY_BUFFER,sizeof(vertices),vertices,GL_STATIC_DRAW);

unsigned int VAO;

glGenVertexArrays(1,&VAO);

glBindVertexArray(VAO);

glVertexAttribPointer(0,3,GL_FLOAT,GL_FALSE,0,(void*)0);

glEnableVertexAttribArray(0);

unsigned int EBO;

glGenBuffers(1,&EBO);

glBindBuffer(GL_ELEMENT_ARRAY_BUFFER,EBO);

glBufferData(GL_ELEMENT_ARRAY_BUFFER,sizeof(indices),indices,GL_STATIC_DRAW);

glBindBuffer(GL_ARRAY_BUFFER, 0);

glBindVertexArray(0);

while(!glfwWindowShouldClose(window)){

glClearColor(0.5f,0.4f,0.3f,1.0f);

glClear(GL_COLOR_BUFFER_BIT);

glBindVertexArray(VAO);

glBindBuffer(GL_ELEMENT_ARRAY_BUFFER,EBO);

glUseProgram(shader_program);

glDrawElements(GL_TRIANGLES,6,GL_UNSIGNED_INT,0);

glBindVertexArray(0);

glBindBuffer(GL_ARRAY_BUFFER,0);

glfwSwapBuffers(window);

glfwPollEvents();

}

glDeleteBuffers(1,&VBO);

glDeleteProgram(shader_program);

glDeleteVertexArrays(1,&VAO);

glfwTerminate();

return 0;

}

正确的操作顺序如下:

- 绑定VAO

- 绑定VBO

- 配置顶点属性

- 启用顶点属性

- 绑定EBO

- 解绑VAO

着色器¶

GLSL¶

典型着色器程序的结构如下:

#version version_number

in type in_variable_name;

in type in_variable_name;

out type out_variable_name;

uniform type uniform_name;

int main()

{

// 处理输入并进行一些图形操作

...

// 输出处理过的结果到输出变量

out_variable_name = weird_stuff_we_processed;

}

对于Vertex Shader,输入变量被称为Vertex Attribute。在OpenGL中一般至少能声明16个Vertex Attribute,每个含4个分量。

向量¶

向量是GLSL中最常用的数据类型。包含vecn、bvecn、ivecn、uvecn、dvecn。前缀代表分量的基本类型,后缀n代表维度数。一般使用vecn。

使用.x、.y、.z和.w来获取它们的第1、2、3、4个分量。GLSL也允许对颜色使用rgba,或是对纹理坐标使用stpq访问相同的分量。

与CG类似,可以通过重组(Swizzling)的方式填充向量分量。

vec2 someVec;

vec4 differentVec = someVec.xyxx;

vec3 anotherVec = differentVec.zyw;

vec4 otherVec = someVec.xxxx + anotherVec.yxzy;

与此同时,还可以使用向量构造函数直接给向量变量复制,如vec2 vect = vec2(0.5, 0.7)

输入输出¶

in和out关键字用于定义着色器的输入和输出。只要一个输出变量与下一个着色器阶段的输入匹配,它就会传递下去(前一阶段的输出变量的变量名,应当与后阶段的输入变量的变量名相同)。但在顶点和片段着色器中会有点不同。

对于Vertex Shader,其特殊点在于location关键字。location定义了着色器从顶点数据的哪一部分接收数据。例如,在Vertex Shader中,我定义了两个vec4,第一个是位置数据aPos,它的location是0;第二个是颜色数据aCol,它的location是1。

使用layout (location = 0)定义某输入变量的location。

对于Fragment Shader,应当始终保证存在一个vec4型输出变量,用于输出最终颜色。

Uniform¶

Uniform用于在cpp程序中向着色器输入数据,改变其表现。

如其名,Uniform在每个着色器程序中都是独一无二的。在这个Program链接的所有Shader中,只能存在一个相同名称的Uniform。

使用uniform关键字定义Uniform变量。

uniform vec4 ourColor;

在cpp程序中改变uniform的代码如下:

float timeValue = glfwGetTime(); //获取当前程序运行的秒数

float greenValue = (sin(timeValue) / 2.0f) + 0.5f;

//使用glGetUniformLocation函数,在shaderProgram程序中获取名为"outColor"的Uniform变量位置

int vertexColorLocation = glGetUniformLocation(shaderProgram, "ourColor");

glUseProgram(shaderProgram);

//获取位置后,使用glUniform4f函数,以之前获取的位置为参数,设置它的值。

glUniform4f(vertexColorLocation, 0.0f, greenValue, 0.0f, 1.0f);

更新uniform值时,必须Use它所在的Program,否则更新无效。

除glUniform4f外,还有glUniform3i(ivec3)、glUniformfv(float[]或vecn)、glUniformui(unsigned int)等。

多顶点属性¶

考虑如下顶点数据:

float vertices[] = {

// 位置 // 颜色

0.5f, -0.5f, 0.0f, 1.0f, 0.0f, 0.0f, // 右下

-0.5f, -0.5f, 0.0f, 0.0f, 1.0f, 0.0f, // 左下

0.0f, 0.5f, 0.0f, 0.0f, 0.0f, 1.0f // 顶部

};

我们知道,可以使用layout(location = x)来标记不同的顶点属性,通过gVertexAttribPointer来告诉程序该如何处理这些不同的属性。

// 位置属性

glVertexAttribPointer(0, 3, GL_FLOAT, GL_FALSE, 6 * sizeof(float), (void*)0);

glEnableVertexAttribArray(0);

// 颜色属性

glVertexAttribPointer(1, 3, GL_FLOAT, GL_FALSE, 6 * sizeof(float), (void*)(3* sizeof(float)));

glEnableVertexAttribArray(1);

自定义着色器类¶

#ifndef SHADER_H

#define SHADER_H

#include <glad/glad.h>

#include <string>

#include <fstream>

#include <sstream>

#include <iostream>

class Shader

{

public:

unsigned int ID;

// constructor generates the shader on the fly

// ------------------------------------------------------------------------

Shader(const char* vertexPath, const char* fragmentPath)

{

// 1. retrieve the vertex/fragment source code from filePath

std::string vertexCode;

std::string fragmentCode;

std::ifstream vShaderFile;

std::ifstream fShaderFile;

// ensure ifstream objects can throw exceptions:

vShaderFile.exceptions (std::ifstream::failbit | std::ifstream::badbit);

fShaderFile.exceptions (std::ifstream::failbit | std::ifstream::badbit);

try

{

// open files

vShaderFile.open(vertexPath);

fShaderFile.open(fragmentPath);

std::stringstream vShaderStream, fShaderStream;

// read file's buffer contents into streams

vShaderStream << vShaderFile.rdbuf();

fShaderStream << fShaderFile.rdbuf();

// close file handlers

vShaderFile.close();

fShaderFile.close();

// convert stream into string

vertexCode = vShaderStream.str();

fragmentCode = fShaderStream.str();

}

catch (std::ifstream::failure& e)

{

std::cout << "ERROR::SHADER::FILE_NOT_SUCCESSFULLY_READ: " << e.what() << std::endl;

}

const char* vShaderCode = vertexCode.c_str();

const char * fShaderCode = fragmentCode.c_str();

// 2. compile shaders

unsigned int vertex, fragment;

// vertex shader

vertex = glCreateShader(GL_VERTEX_SHADER);

glShaderSource(vertex, 1, &vShaderCode, NULL);

glCompileShader(vertex);

checkCompileErrors(vertex, "VERTEX");

// fragment Shader

fragment = glCreateShader(GL_FRAGMENT_SHADER);

glShaderSource(fragment, 1, &fShaderCode, NULL);

glCompileShader(fragment);

checkCompileErrors(fragment, "FRAGMENT");

// shader Program

ID = glCreateProgram();

glAttachShader(ID, vertex);

glAttachShader(ID, fragment);

glLinkProgram(ID);

checkCompileErrors(ID, "PROGRAM");

// delete the shaders as they're linked into our program now and no longer necessary

glDeleteShader(vertex);

glDeleteShader(fragment);

}

// activate the shader

// ------------------------------------------------------------------------

void use()

{

glUseProgram(ID);

}

// utility uniform functions

// ------------------------------------------------------------------------

void setBool(const std::string &name, bool value) const

{

glUniform1i(glGetUniformLocation(ID, name.c_str()), (int)value);

}

// ------------------------------------------------------------------------

void setInt(const std::string &name, int value) const

{

glUniform1i(glGetUniformLocation(ID, name.c_str()), value);

}

// ------------------------------------------------------------------------

void setFloat(const std::string &name, float value) const

{

glUniform1f(glGetUniformLocation(ID, name.c_str()), value);

}

private:

// utility function for checking shader compilation/linking errors.

// ------------------------------------------------------------------------

void checkCompileErrors(unsigned int shader, std::string type)

{

int success;

char infoLog[1024];

if (type != "PROGRAM")

{

glGetShaderiv(shader, GL_COMPILE_STATUS, &success);

if (!success)

{

glGetShaderInfoLog(shader, 1024, NULL, infoLog);

std::cout << "ERROR::SHADER_COMPILATION_ERROR of type: " << type << "\n" << infoLog << "\n -- --------------------------------------------------- -- " << std::endl;

}

}

else

{

glGetProgramiv(shader, GL_LINK_STATUS, &success);

if (!success)

{

glGetProgramInfoLog(shader, 1024, NULL, infoLog);

std::cout << "ERROR::PROGRAM_LINKING_ERROR of type: " << type << "\n" << infoLog << "\n -- --------------------------------------------------- -- " << std::endl;

}

}

}

};

#endif

Shader对象的构造必须要在加载完GLAD proc以后,否则报错。

纹理¶

简介¶

纹理(Texture)用于在不增加顶点数量的情况下添加物体的细节。它就像一层贴纸一样贴在几何体上。

纹理也可以用来存储数据。

纹理“贴”到几何体上的过程被称为映射(Map)。纹理坐标(Texture Coordinate)用于指定某个顶点该从纹理的哪个位置采样(Sample,采集Fragment颜色)。非顶点的几何体区域通过片段插值(Fragment Interpolation)采样。

纹理坐标以左下角为原点,右上角为(1, 1)点。

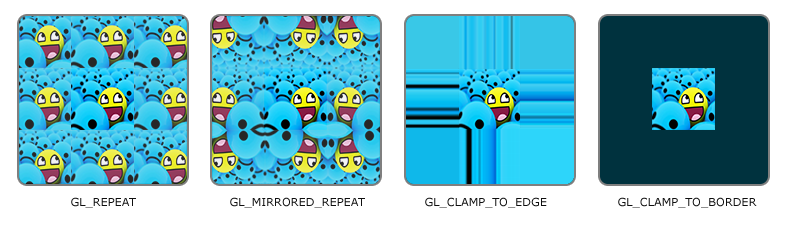

对于超出[0, 1]范围的纹理坐标,可以指定纹理环绕方式来处理。

| 环绕方式 | 描述 |

|---|---|

| GL_REPEAT | 对纹理的默认行为。重复纹理图像。(用于二方连续纹理) |

| GL_MIRRORED_REPEAT | 和GL_REPEAT一样,但每次重复图片是镜像放置的。 |

| GL_CLAMP_TO_EDGE | 纹理坐标会被约束在0到1之间,超出的部分会重复纹理坐标的边缘,产生一种边缘被拉伸的效果。(Unity中默认模式) |

| GL_CLAMP_TO_BORDER | 超出的坐标为用户指定的边缘颜色。 |

使用glTexParameterx函数对特定坐标轴设置环绕方式。其中的‘x’代表数据类型,如i(int)、fv(float[])等。

//参数一指定纹理目标

//参数二指定参数选项以及坐标轴。S轴(x轴)T轴(y轴)

//参数三指定环绕方式

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_MIRRORED_REPEAT);

选择GL_CLAMP_TO_BORDER时,使用float数组传入颜色数据。

float borderColor[] = { 1.0f, 1.0f, 0.0f, 1.0f };

glTexParameterfv(GL_TEXTURE_2D, GL_TEXTURE_BORDER_COLOR, borderColor);

纹理过滤¶

纹理坐标可以是任意精度的浮点值,但纹理本身的分辨率却是有限的。因此,OpenGL需要知道,当指定一个纹理坐标时,该如何采样这个点上的像素。最为常见的是GL_NEAREST和GL_LINEAR。前者选择最接近坐标的哪个像素,后者会基于坐标附近的像素,计算出插值。像素中心离坐标越近,它对最终颜色的贡献就越大。

二者的主要区别在于,前者会显得更“锯齿”,后者会显得更“模糊”。

当缩放几何体的时候,常常需要对纹理过滤进行设置,通常的做法是在纹理被缩小的时候使用邻近过滤,被放大时使用线性过滤。因为纹理缩小时,纹理像素也会变小,在视觉上,它的“分辨率似乎提高了”。因此,此时采用NEAREST过滤,纹理看起来就不会那么“锯齿化”。纹理放大时,像素看起来会更”明显“,所以使用LINEAR方法让纹理像素不那么明显,过渡更加平滑。

使用glTexParameterx函数为放大和缩小操作指定过滤方式。

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_NEAREST);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_LINEAR);

多级渐远纹理¶

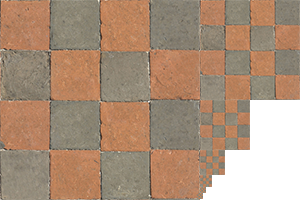

在我们当前的理解中,无论物体远近,其被映射的纹理的分辨率是不变的。对于非常远的物体,它们只会产生很少的Fragment。而OpenGL需要在如此高分辨率的纹理上拾取区区几个像素,是非常困难,并且效果不好的。为了解决这一问题,OpenGL引入了多级渐远纹理(Mipmap)。

Mipmap中,每个纹理的大小是前一个纹理的二分之一。当物体与相机的距离超过一定阈值后,OpenGL会采用小一级的纹理进行采样。

通过glGenerateMipmap函数创建Mipmap。

与纹理过滤选项类似,OpenGL提供了多种Mipmap匹配选项,用于缓解阈值附近Mipmap切换突兀的问题。

| 过滤方式 | 描述 |

|---|---|

| GL_NEAREST_MIPMAP_NEAREST | 使用最邻近的多级渐远纹理来匹配像素大小,并使用邻近插值进行纹理采样 |

| GL_LINEAR_MIPMAP_NEAREST | 使用最邻近的多级渐远纹理级别,并使用线性插值进行采样 |

| GL_NEAREST_MIPMAP_LINEAR | 在两个最匹配像素大小的多级渐远纹理之间进行线性插值,使用邻近插值进行采样 |

| GL_LINEAR_MIPMAP_LINEAR | 在两个邻近的多级渐远纹理之间使用线性插值,并使用线性插值进行采样 |

使用glTexParameteri设置Mipmap过滤方式。

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_LINEAR_MIPMAP_LINEAR);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_LINEAR);

一般只会对MIN_FILTER选项使用Mipmap。对MAG_FILTER使用Mipmap是不正确的。

加载与创建¶

头文件stb_image.h中的stbi_load函数接收图片路径作为输入,将图片的宽度、高度和颜色通道数输出到三个int变量上。

int width, height, nrChannels;

unsigned char *data = stbi_load("container.jpg", &width, &height, &nrChannels, 0);

与glGenBuffers类似,使用glGenTextures(int cnt, unsigned int* addr)生成纹理对象并获取句柄。

使用glBindTexture(GL_TEXTURE_2D, unsigned int texture)绑定纹理对象句柄与上下文目标。

使用glTexImage2d将图片信息复制到上下文目标中。

//上下文目标 | Mipmap级别 | 纹理存储格式 | 图片宽度 | 图片高度 | 总是为0 | 原图的格式 | 原图的数据类型 | 图像数据

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGB, width, height, 0, GL_RGB, GL_UNSIGNED_BYTE, data);

glGenerateMipmap(GL_TEXTURE_2D);

与glBufferData类似,glTexImage2d的作用就是让当前绑定的纹理对象附加上真正的纹理图像。

glGenerateMipmap(GL_TEXTURE_2D)让OpenGL自动为我们生成、配置Mipmap,无需手动配置。

完成纹理和Mipmap生成后,应当释放图片内存:stbi_image_free(data);

完整的生成纹理过程如下:

unsigned int texture;

glGenTextures(1, &texture);

glBindTexture(GL_TEXTURE_2D, texture);

// 为当前绑定的纹理对象设置环绕、过滤方式

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_T, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_LINEAR);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_LINEAR);

// 加载并生成纹理

int width, height, nrChannels;

unsigned char *data = stbi_load("container.jpg", &width, &height, &nrChannels, 0);

if (data)

{

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGB, width, height, 0, GL_RGB, GL_UNSIGNED_BYTE, data);

glGenerateMipmap(GL_TEXTURE_2D);

}

else

{

std::cout << "Failed to load texture" << std::endl;

}

stbi_image_free(data);

纹理单元¶

sample2d类型uniform无需使用glUniform赋值。但glUniform可以设置sampler2d的位置值,这样我们就能给着色器设置多个纹理。一个纹理的位置值称为一个纹理单元(Texture Unit),其默认值为0。

使用glActiveTexture(GL_TEXTUREX)激活X号纹理单元, 随后使用glBindTexture为该位置值的纹理单元绑定纹理对象。

glActiveTexture(GL_TEXTURE0);

glBindTexture(GL_TEXTURE_2D, texture1);

glActiveTexture(GL_TEXTURE1);

glBindTexture(GL_TEXTURE_2D, texture2);

使用自定义着色器类的setInt函数设置纹理单元位置值。

ourShader.setInt("texture2", 1);

在OpenGL中,纹理坐标的原点在左下角。而多数图像文件格式如PNG、JPEG等原点在左上角。所以直接加载这类图片会导致图片上下颠倒。

使用stbi_set_flip_vertically_on_load(true)反转图片y轴。

完整代码¶

#include <iostream>

#include <glad/glad.h>

#include <GLFW/glfw3.h>

#include <valarray>

#include "shader_s.h"

#include "stb_image.h"

using namespace std;

float vertices[] = {

// ---- 位置 ---- ---- 颜色 ---- - 纹理坐标 -

0.5f, 0.5f, 0.0f, 1.0f, 0.0f, 0.0f, 1.0f, 1.0f, // 右上

0.5f, -0.5f, 0.0f, 0.0f, 1.0f, 0.0f, 1.0f, 0.0f, // 右下

-0.5f, -0.5f, 0.0f, 0.0f, 0.0f, 1.0f, 0.0f, 0.0f, // 左下

-0.5f, 0.5f, 0.0f, 1.0f, 1.0f, 0.0f, 0.0f, 1.0f // 左上

};

unsigned int indices[] = {

0, 1, 2,

0, 2, 3

};

void frame_buffer_size_callback(GLFWwindow* window, int width, int height) {

glViewport(0, 0, width, height);

}

int main() {

// glfw初始化

glfwInit();

glfwWindowHint(GLFW_CONTEXT_VERSION_MAJOR, 3);

glfwWindowHint(GLFW_CONTEXT_VERSION_MINOR, 3);

glfwWindowHint(GLFW_OPENGL_PROFILE, GLFW_OPENGL_CORE_PROFILE);

GLFWwindow* window = glfwCreateWindow(800, 600, "LearnOpenGL", NULL, NULL);

if (window == NULL) {

cout << "Failed to create window" << endl;

glfwTerminate();

return -1;

}

glfwMakeContextCurrent(window);

if (!gladLoadGLLoader((GLADloadproc)glfwGetProcAddress)) {

cout << "Failed to load proc" << endl;

glfwTerminate();

return -1;

}

glViewport(0, 0, 800, 600);

glfwSetFramebufferSizeCallback(window, frame_buffer_size_callback);

Shader shader("C:\\Users\\msik\\CLionProjects\\LearnOpenGL\\Shaders\\vertex.glsl", "C:\\Users\\msik\\CLionProjects\\LearnOpenGL\\Shaders\\fragment.glsl");

// 加载纹理

unsigned char* data[2];

int width[2], height[2], channels[2];

stbi_set_flip_vertically_on_load(true);

data[0] = stbi_load("C:\\Users\\msik\\CLionProjects\\LearnOpenGL\\container.jpg", &width[0], &height[0], &channels[0], 0);

data[1] = stbi_load("C:\\Users\\msik\\CLionProjects\\LearnOpenGL\\awesomeface.png", &width[1], &height[1], &channels[1], 0);

unsigned int textures[2];

glGenTextures(2, textures);

// 纹理1

glBindTexture(GL_TEXTURE_2D, textures[0]);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_T, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_LINEAR_MIPMAP_LINEAR);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_LINEAR);

if (data[0]) {

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGB, width[0], height[0], 0, GL_RGB, GL_UNSIGNED_BYTE, data[0]);

glGenerateMipmap(GL_TEXTURE_2D);

} else {

cout << "Failed to load texture 1" << endl;

}

// 纹理2

glBindTexture(GL_TEXTURE_2D, textures[1]);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_S, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_WRAP_T, GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MIN_FILTER, GL_LINEAR_MIPMAP_LINEAR);

glTexParameteri(GL_TEXTURE_2D, GL_TEXTURE_MAG_FILTER, GL_LINEAR);

if (data[1]) {

glTexImage2D(GL_TEXTURE_2D, 0, GL_RGBA, width[1], height[1], 0, GL_RGBA, GL_UNSIGNED_BYTE, data[1]);

glGenerateMipmap(GL_TEXTURE_2D);

} else {

cout << "Failed to load texture 2" << endl;

}

// 释放图像数据

stbi_image_free(data[0]);

stbi_image_free(data[1]);

// VAO

unsigned int VAO;

glGenVertexArrays(1, &VAO);

glBindVertexArray(VAO);

// VBO

unsigned int VBO;

glGenBuffers(1, &VBO);

glBindBuffer(GL_ARRAY_BUFFER, VBO);

glBufferData(GL_ARRAY_BUFFER, sizeof(vertices), vertices, GL_STATIC_DRAW);

// EBO

unsigned int EBO;

glGenBuffers(1, &EBO);

glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, EBO);

glBufferData(GL_ELEMENT_ARRAY_BUFFER, sizeof(indices), indices, GL_STATIC_DRAW);

// 顶点属性PTR

glVertexAttribPointer(0, 3, GL_FLOAT, GL_FALSE, 8 * sizeof(float), (void*)0);

glEnableVertexAttribArray(0);

glVertexAttribPointer(1, 3, GL_FLOAT, GL_FALSE, 8 * sizeof(float), (void*)(3 * sizeof(float)));

glEnableVertexAttribArray(1);

glVertexAttribPointer(2, 2, GL_FLOAT, GL_FALSE, 8 * sizeof(float), (void*)(6 * sizeof(float)));

glEnableVertexAttribArray(2);

shader.use();

shader.setInt("texture1", 0);

shader.setInt("texture2", 1);

while (!glfwWindowShouldClose(window)) {

glClearColor(0.2f, 0.3f, 0.4f, 1.0f);

glClear(GL_COLOR_BUFFER_BIT);

// 绑定纹理

glActiveTexture(GL_TEXTURE0);

glBindTexture(GL_TEXTURE_2D, textures[0]);

glActiveTexture(GL_TEXTURE1);

glBindTexture(GL_TEXTURE_2D, textures[1]);

shader.use();

glBindVertexArray(VAO);

glDrawElements(GL_TRIANGLES, 6, GL_UNSIGNED_INT, 0);

glfwSwapBuffers(window);

glfwPollEvents();

}

glfwTerminate();

return 0;

}

#version 330 core

in vec3 col;

in vec2 uv;

out vec4 fragcolor;

uniform sampler2D texture1;

uniform sampler2D texture2;

void main(){

fragcolor = mix(texture(texture1,uv),texture(texture2,uv),0.2f);

}

#version 330 core

layout (location = 0) in vec3 aPos;

layout (location = 1) in vec3 aCol;

layout (location = 2) in vec2 aTex;

out vec3 col;

out vec2 uv;

void main(){

gl_Position = vec4(aPos,1.0);

col = aCol;

uv = aTex;

}

变换¶

缩放¶

三维空间的变换矩阵一般都是四维矩阵。w分量与具体变换无关。

位移¶

可以看到,因为有了w分量,所以才能实现位移。

w分量被称为齐次坐标(Homogeneous Coordinates)。齐次坐标为0的向量被称为方向向量,它无法被位移。

旋转¶

上面三个矩阵分别是以x、y、z轴旋转θ°的旋转矩阵。

这些矩阵复合可能会导致万向节死锁。沿任意旋转轴旋转θ°的旋转矩阵如下: $$ \begin{bmatrix} \cos \theta + \color{red}{R_x}^2(1 - \cos \theta) & \color{red}{R_x}\color{green}{R_y}(1 - \cos \theta) - \color{blue}{R_z} \sin \theta & \color{red}{R_x}\color{blue}{R_z}(1 - \cos \theta) + \color{green}{R_y} \sin \theta & 0 \ \color{green}{R_y}\color{red}{R_x} (1 - \cos \theta) + \color{blue}{R_z} \sin \theta & \cos \theta + \color{green}{R_y}^2(1 - \cos \theta) & \color{green}{R_y}\color{blue}{R_z}(1 - \cos \theta) - \color{red}{R_x} \sin \theta & 0 \ \color{blue}{R_z}\color{red}{R_x}(1 - \cos \theta) - \color{green}{R_y} \sin \theta & \color{blue}{R_z}\color{green}{R_y}(1 - \cos \theta) + \color{red}{R_x} \sin \theta & \cos \theta + \color{blue}{R_z}^2(1 - \cos \theta) & 0 \ 0 & 0 & 0 & 1 \end{bmatrix} $$

组合¶

当矩阵相乘时,在最右边的矩阵是第一个与向量相乘的,所以应该从右向左读矩阵乘法。

建议:在组合矩阵时,先进行缩放操作,然后是旋转,最后才是位移

GLM¶

GLM是在OpenGL中使用各类数学函数的头文件库。

#include <glm/glm.hpp>

#include <glm/gtc/matrix_transform.hpp>

#include <glm/gtc/type_ptr.hpp>

glm::vec4 vec(x,y,z,w)用于创建一个名为vec的四维向量。

glm::mat4 trans = glm::mat4(1.0f)用于创建一个名为trans的四维矩阵,它是一个单位矩阵。

直接使用glm::mat4创建矩阵,会生成一个零矩阵。

当需要对一个向量进行变换操作时,用它乘以对应的变换矩阵即可。

平移¶

glm::translate(mat4, vec3)用于创建一个位移变换矩阵。mat4一般就是单位矩阵,vec3是位移向量。

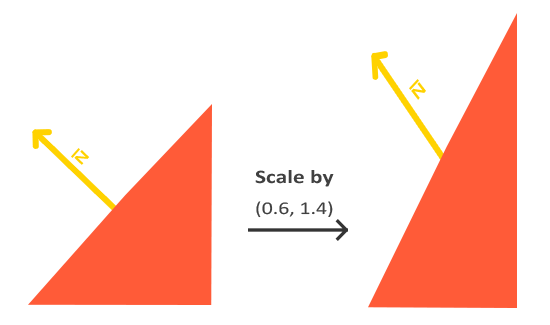

缩放¶

glm::scale(mat4, vec3)用于创建缩放变换矩阵。mat4是单位矩阵,vec3是各轴缩放系数。

旋转¶

glm::rotate(mat4, radians, vec3)用于创建旋转矩阵。mat4是单位矩阵,radians是需要旋转的弧度,vec3是旋转轴。

radians是一个glm::radians类型变量,表示弧度。通过glm::radians(float angle)可把角度转换为弧度。

数据传递¶

定义mat4类型的uniform,使用如下代码传递:

unsigned int transformLoc = glGetUniformLocation(ourShader.ID, "transform");

//参数二:传递矩阵的个数

//参数三:是否转置。使用GLM(列主序)时无需转置

//参数四:把GLM矩阵转换为OpenGL可以读懂的类型

glUniformMatrix4fv(transformLoc, 1, GL_FALSE, glm::value_ptr(trans));

存在多个对象时,需要单独对每个对象进行变换。

shader.use();

glm::mat4 trans = glm::mat4(1.0f);

trans = glm::translate(trans,glm::vec3(-0.5f, 0.0f, 0.0f));

trans = glm::scale(trans,glm::vec3(sin(glfwGetTime()),sin(glfwGetTime()),0));

unsigned int transLoc = glGetUniformLocation(shader.ID,"trans");

glUniformMatrix4fv(transLoc,1,GL_FALSE,glm::value_ptr(trans));

glDrawElements(GL_TRIANGLES,6,GL_UNSIGNED_INT,0);

trans = glm::mat4(1.0f);

trans = glm::translate(trans,glm::vec3(0.5f, -0.5f, 0.0f));

trans = glm::rotate(trans,100*glm::radians((float)glfwGetTime()),glm::vec3(0,0,1));

glUniformMatrix4fv(transLoc,1,GL_FALSE,glm::value_ptr(trans));

glDrawElements(GL_TRIANGLES,6,GL_UNSIGNED_INT,0);

坐标¶

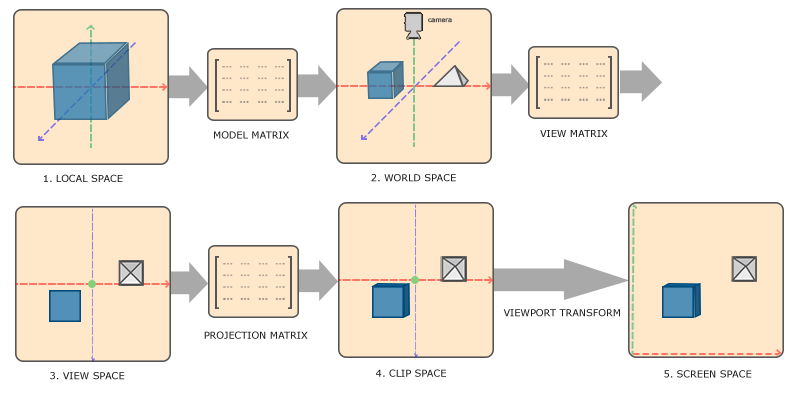

通常情况下,顶点坐标不一定在NDC范围以内。我们需要在顶点着色器中自行把这些坐标转化为NDC坐标。

这个坐标转化的过程类似于流水线。

在坐标转换的过程中,有三个变换矩阵非常重要:

- 模型(Model)矩阵

- 观察(View)矩阵

- 投影(Projection)矩阵

坐标变换以下列顺序进行:

局部坐标 -> 世界坐标 -> 观察坐标 -> 裁剪坐标 -> 屏幕坐标

坐标变换概述:

- 局部坐标是对象相对于局部原点的坐标,也是物体起始的坐标。

- 下一步是将局部坐标变换为世界空间坐标,世界空间坐标是处于一个更大的空间范围的。这些坐标相对于世界的全局原点,它们会和其它物体一起相对于世界的原点进行摆放。

- 接下来我们将世界坐标变换为观察空间坐标,使得每个坐标都是从摄像机或者说观察者的角度进行观察的。

- 坐标到达观察空间之后,我们需要将其投影到裁剪坐标。裁剪坐标会被处理至-1.0到1.0的范围内,并判断哪些顶点将会出现在屏幕上。

- 最后,我们将裁剪坐标变换为屏幕坐标,我们将使用一个叫做视口变换(Viewport Transform)的过程。视口变换将位于-1.0到1.0范围的坐标变换到由glViewport函数所定义的坐标范围内。最后变换出来的坐标将会送到光栅器,将其转化为片段。

局部空间¶

单个物体所在的坐标空间。只在单个物体上有意义。

世界空间¶

每个物体摆放的不同位置。

使用模型矩阵将局部左边转换为世界坐标。

观察空间¶

又称摄像机空间或视觉空间,是从摄像机的视角所观察到的空间。

使用观察矩阵,将世界坐标转换为观察坐标。

裁剪空间¶

对于任何屏幕上不可见的坐标,都应当被剔除。剔除完以后,剩下的坐标就是屏幕上可见的片段。

使用投影矩阵将观察坐标变换到裁剪坐标。投影矩阵指定了一个范围的坐标,比如在每个维度上的-1000到1000。投影矩阵接着会将在这个指定的范围内的坐标变换为标准化设备坐标的范围(-1.0, 1.0)。所有在范围外的坐标不会被映射到在-1.0到1.0的范围之间,所以会被裁剪掉。

若一个图元一部分在裁剪范围内,一部分在范围外,在交界处将会生成新的顶点。

投影矩阵创建了一个观察箱(Viewing Box),这个观察箱被称为平截头体(Frustum,Unity里称为视锥)。

投影(Projection)是把特定范围内的坐标转换到NDC范围内的过程。

OpenGL Projection Matrix (songho.ca)

所有顶点被变换到裁剪空间后,一次透视除法将会执行。具体表现为:位置向量的x,y,z分量分别除以齐次w分量。这一步骤由顶点着色器自动执行。

随后,最终坐标会被映射到屏幕空间中,并被变换为Fragment。

投影矩阵分为正交(Orthographic)和透视(Perspective)投影矩阵。

正交投影矩阵所框定的范围类似于一个长方体。变换后,每个向量的w分量都不会改变。

使用

glm::ortho(left, right, bottom, top, near, far)创建正射投影矩阵。前两个参数为Frustum的左右坐标,第三、第四个参数为底部和顶部。第五第六个参数为近平面和远平面。

投射投影矩阵所框定的范围类似于一个四边台体。它会修改每个顶点坐标的w值,使得离观察者越远的顶点坐标,w分量就越大。这样,在执行透视除法时,越远的顶点坐标,其x、y、z值会被除的越多,就好像被缩小了一样,从而达成“近大远小”的效果。

使用

glm::mat4 proj = glm::perspective(glm::radians(angle), (float)width / (float)height, near, far)创建投影矩阵。参数一定义了视野(Field of view,FOV)的值,通常为45.0f.

参数二定义了宽高比。

参数三、四为近平面和远平面。

组合¶

V_{clip} = M_{projection} \cdot M_{view} \cdot M_{model} \cdot V_{local}

经过上面的变换后,就能得到应当被赋给gl_Position的坐标。随后,Vertex Shader对其进行透视除法和裁剪。

实践¶

首先创建模型矩阵。一种直观理解模型矩阵的方式是,Unity中的Transform组件。

模型矩阵对物体本身进行平移、旋转、缩放操作,对应Transform的三个属性。

要绘制世界坐标不同的物体的时候,只需要创建不同的模型矩阵即可。

glm::mat4 model;

//该模型矩阵让物体绕x轴旋转-55°

model = glm::rotate(model, glm::radians(-55.0f), glm::vec3(1.0f, 0.0f, 0.0f));

随后创建观察矩阵。当没有观察矩阵时,摄像机处于世界空间原点。在使用上面那个模型矩阵变换的情况下,物体同样处在世界原点。所以我们要往后退,以看到物体。而往后退等价于让物体往后退,所以有观察矩阵:

glm::mat4 view;

// 注意,我们将矩阵向我们要进行移动场景的反方向移动。

// OpenGL使用右手坐标系,z轴正方向指向屏幕外。

view = glm::translate(view, glm::vec3(0.0f, 0.0f, -3.0f));

最后创建投影矩阵。

glm::mat4 projection;

projection = glm::perspective(glm::radians(45.0f), screenWidth / screenHeight, 0.1f, 100.0f);

然后修改Vertex Shader,并传入变换矩阵

#version 330 core

layout (location = 0) in vec3 aPos;

layout (location = 1) in vec3 aCol;

layout (location = 2) in vec2 aTex;

out vec3 col;

out vec2 uv;

uniform mat4 model;

uniform mat4 view;

uniform mat4 proj;

void main(){

gl_Position = proj*view*model*vec4(aPos,1.0);

col = aCol;

uv = aTex;

}

unsigned int modelLoc = glGetUniformLocation(shader.ID,"model");

unsigned int viewLoc = glGetUniformLocation(shader.ID,"view");

unsigned int projLoc = glGetUniformLocation(shader.ID,"proj");

glUniformMatrix4fv(modelLoc,1,GL_FALSE,glm::value_ptr(model));

glUniformMatrix4fv(viewLoc,1,GL_FALSE,glm::value_ptr(view));

glUniformMatrix4fv(projLoc,1,GL_FALSE,glm::value_ptr(proj));

glDrawElements(GL_TRIANGLES,6,GL_UNSIGNED_INT,0);

Z-Buffer¶

绘制立方体时,使用Z-Buffer解决覆盖问题。

GLFW自动生成Z-Buffer存储深度信息。片段想要输出它的颜色时,OpenGL会将它的深度值和z缓冲进行比较,如果当前的片段在其它片段之后,它将会被丢弃,否则将会覆盖。这个过程称为深度测试(Depth Testing),它是由OpenGL自动完成的。

深度测试默认关闭,使用glEnable(GL_DEPTH_TEST)开启。

同时,深度缓冲也需要在每帧清除。

glClear(GL_COLOR_BUFFER_BIT | GL_DEPTH_BUFFER_BIT);

绘制许多物体时,不妨使用for循环+改变model矩阵的方式。

完整代码¶

#include <iostream>

#include <glad/glad.h>

#include <GLFW/glfw3.h>

#include "shader_s.h"

#include "stb_image.h"

#include <glm/glm.hpp>

#include <glm/gtc/matrix_transform.hpp>

#include <glm/gtc/type_ptr.hpp>

using namespace std;

float offsetX=0;

float offsetY=0;

float offsetZ=0;

glm::vec3 cubePositions[] = {

glm::vec3( 0.0f, 0.0f, 0.0f),

glm::vec3( 2.0f, 5.0f, -15.0f),

glm::vec3(-1.5f, -2.2f, -2.5f),

glm::vec3(-3.8f, -2.0f, -12.3f),

glm::vec3( 2.4f, -0.4f, -3.5f),

glm::vec3(-1.7f, 3.0f, -7.5f),

glm::vec3( 1.3f, -2.0f, -2.5f),

glm::vec3( 1.5f, 2.0f, -2.5f),

glm::vec3( 1.5f, 0.2f, -1.5f),

glm::vec3(-1.3f, 1.0f, -1.5f)

};

float vertices[] = {

-0.5f, -0.5f, -0.5f, 0.0f, 0.0f,

0.5f, -0.5f, -0.5f, 1.0f, 0.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 0.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 1.0f,

0.5f, 0.5f, 0.5f, 1.0f, 1.0f,

-0.5f, 0.5f, 0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

0.5f, -0.5f, -0.5f, 1.0f, 1.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

0.5f, -0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, -0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, -0.5f, -0.5f, 0.0f, 1.0f,

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f,

0.5f, 0.5f, -0.5f, 1.0f, 1.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

0.5f, 0.5f, 0.5f, 1.0f, 0.0f,

-0.5f, 0.5f, 0.5f, 0.0f, 0.0f,

-0.5f, 0.5f, -0.5f, 0.0f, 1.0f

};

void process_input(GLFWwindow* window) {

if(glfwGetKey(window,GLFW_KEY_RIGHT)==GLFW_PRESS) {

offsetX+=0.01f;

}

else if(glfwGetKey(window,GLFW_KEY_LEFT)==GLFW_PRESS) {

offsetX-=0.01f;

}

if(glfwGetKey(window,GLFW_KEY_UP)==GLFW_PRESS) {

offsetY+=0.01f;

}

else if(glfwGetKey(window,GLFW_KEY_DOWN)==GLFW_PRESS) {

offsetY-=0.01f;

}

}

void mouse_scroll_zoom(GLFWwindow* window, double xoffset, double yoffset) {

if(yoffset>0) {

offsetZ+=0.1f;

}

else if(yoffset<0) {

offsetZ-=0.1f;

}

}

void frame_buffer_size_callback(GLFWwindow* window, int width, int height) {

glViewport(0,0,width,height);

}

GLFWwindow* sys_init(int width, int height) {

//glfw初始化

glfwInit();

glfwWindowHint(GLFW_CONTEXT_VERSION_MAJOR,3);

glfwWindowHint(GLFW_CONTEXT_VERSION_MINOR,3);

glfwWindowHint(GLFW_OPENGL_PROFILE,GLFW_OPENGL_CORE_PROFILE);

GLFWwindow* window = glfwCreateWindow(800,600,"LearnOpenGL",NULL,NULL);

if(window==NULL) {

cout<<"Failed to create window"<<endl;

glfwTerminate();

return NULL;

}

glfwMakeContextCurrent(window);

if(!gladLoadGLLoader((GLADloadproc)glfwGetProcAddress)) {

cout<<"Failed to load proc"<<endl;

glfwTerminate();

return NULL;

}

glViewport(0,0,800,600);

glfwSetFramebufferSizeCallback(window,frame_buffer_size_callback);

glfwSetScrollCallback(window,mouse_scroll_zoom);

return window;

}

void quick_config_buffers(unsigned int GLTYPE, unsigned int* handle, void* data, unsigned int size) {

glGenBuffers(1, handle);

glBindBuffer(GLTYPE, *handle);

glBufferData(GLTYPE, size, data, GL_STATIC_DRAW);

}

void quick_config_vao(unsigned int *VAO, unsigned int *VBO, unsigned int *EBO) {

glGenVertexArrays(1, VAO);

glBindVertexArray(*VAO);

glBindBuffer(GL_ARRAY_BUFFER, *VBO);

glBindBuffer(GL_ELEMENT_ARRAY_BUFFER, *EBO);

// 激活顶点属性

glVertexAttribPointer(0, 3, GL_FLOAT, GL_FALSE, 5 * sizeof(float), (void*)0);

glEnableVertexAttribArray(0);

glVertexAttribPointer(1, 2, GL_FLOAT, GL_FALSE, 5 * sizeof(float), (void*)(3 * sizeof(float)));

glEnableVertexAttribArray(1);

glBindVertexArray(0); // Unbind VAO

}

unsigned int quick_config_texture(const char* path,unsigned int IMAGETYPE) {

unsigned int texture;

stbi_set_flip_vertically_on_load(true);

glGenTextures(1,&texture);

glBindTexture(GL_TEXTURE_2D,texture);

glTexParameteri(GL_TEXTURE_2D,GL_TEXTURE_WRAP_S,GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D,GL_TEXTURE_WRAP_T,GL_REPEAT);

glTexParameteri(GL_TEXTURE_2D,GL_TEXTURE_MIN_FILTER,GL_LINEAR_MIPMAP_LINEAR);

glTexParameteri(GL_TEXTURE_2D,GL_TEXTURE_MAG_FILTER,GL_LINEAR);

int width,height,channels;

unsigned char* data = stbi_load(path, &width, &height,&channels,0);

if(data) {

glTexImage2D(GL_TEXTURE_2D,0,IMAGETYPE,width,height,0,IMAGETYPE,GL_UNSIGNED_BYTE,data);

glGenerateMipmap(GL_TEXTURE_2D);

}

else {

cout<<"Failed to load image"<<endl;

return 0;

}

stbi_image_free(data);

return texture;

}

int main() {

//初始化系统与函数加载

GLFWwindow* window = sys_init(800,600);

if(window==NULL) return -1;

//加载着色器

Shader shader("Shaders/vertex.glsl","Shaders/fragment.glsl");

//配置VBO、EBO、VAO

unsigned int VBO, EBO, VAO;

quick_config_buffers(GL_ARRAY_BUFFER, &VBO, vertices, sizeof(vertices));

quick_config_vao(&VAO, &VBO, &EBO);

//加载、配置纹理

unsigned int textures[2];

textures[0]=quick_config_texture("Imgs/container.jpg",GL_RGB);

textures[1]=quick_config_texture("Imgs/awesomeface.png",GL_RGBA);

shader.use();

shader.setInt("texture1",0);

shader.setInt("texture2",1);

glActiveTexture(GL_TEXTURE0);

glBindTexture(GL_TEXTURE_2D,textures[0]);

glActiveTexture(GL_TEXTURE1);

glBindTexture(GL_TEXTURE_2D,textures[1]);

glEnable(GL_DEPTH_TEST);

while(!glfwWindowShouldClose(window)) {

process_input(window);

glClearColor(0.2f,0.3f,0.4f,1.0f);

glClear(GL_COLOR_BUFFER_BIT | GL_DEPTH_BUFFER_BIT);

shader.use();

//变换

glm::mat4 view = glm::mat4(1.0f);

view = glm::translate(view,glm::vec3(0.0f+offsetX,0.0f+offsetY,-3.0f+offsetZ));

glm::mat4 proj = glm::perspective(glm::radians(45.0f),800.0f/600.0f,0.1f,100.0f);

shader.setMat4("view",view);

shader.setMat4("proj",proj);

glBindVertexArray(VAO);

for(unsigned int i = 0; i < 10; i++)

{

glm::mat4 model = glm::mat4(1.0f);

model = glm::translate(model, cubePositions[i]);

float angle = 20.0f * i;

model = glm::rotate(model, (float)glfwGetTime()*glm::radians(angle), glm::vec3(1.0f, 0.3f, 0.5f));

shader.setMat4("model", model);

glDrawArrays(GL_TRIANGLES, 0, 36);

}

//收尾操作

glfwSwapBuffers(window);

glfwPollEvents();

}

glDeleteTextures(2,textures);

glfwTerminate();

}

#version 330 core

layout (location = 0) in vec3 aPos;

layout (location = 1) in vec2 aTex;

out vec2 uv;

uniform mat4 model;

uniform mat4 view;

uniform mat4 proj;

void main(){

gl_Position = proj*view*model*vec4(aPos,1.0);

uv = aTex;

}

#version 330 core

layout (location = 0) in vec3 aPos;

layout (location = 1) in vec2 aTex;

out vec2 uv;

uniform mat4 model;

uniform mat4 view;

uniform mat4 proj;

void main(){

gl_Position = proj*view*model*vec4(aPos,1.0);

uv = aTex;

}

摄像机¶

定义一个摄像机,需要获取其世界坐标、观察方向、指向其右侧与上方的方向向量。

-

世界坐标:与观察矩阵所使用的变换相同。

-

glm::vec3 cameraPos = glm::vec3(0.0f,0.0f,3.0f) -

观察方向:借助矢量相减,获取摄像机位置与世界原点之间的方向向量。

-

glm::vec3 cameraDir = glm::normalize(cameraPos - vec3(0.0f,0.0f,0.0f)) -

这样得到的实际上是观察方向的反方向。

-

右轴:将上向量与观察方向叉乘。

-

c++ glm::vec3 up = glm::vec3(0.0f,1.0f,0.0f); glm::vec3 cameraRight = glm::normalize(glm::cross(up,cameraDir)); -

上轴:将右轴与观察方向叉乘。

glm::vec3 cameraUp = glm::normalize(glm::cross(cameraRight,cameraDir))

上面的操作定义了一个额外的坐标空间。

这个操作被称为格拉姆-施密特正交化(Gram-Schmidt Process)

LookAt矩阵¶

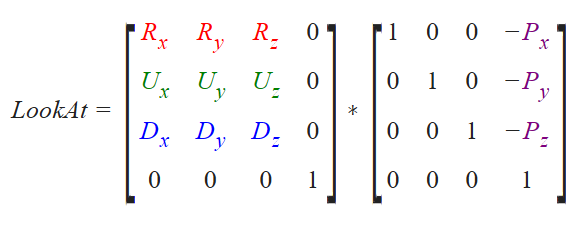

坐标空间被定义后,便可以创建一个矩阵。把这个矩阵乘以任意向量,便可以把这个向量变换到我们定义的坐标空间。在摄像机空间中,这个矩阵被称为LookAt矩阵。

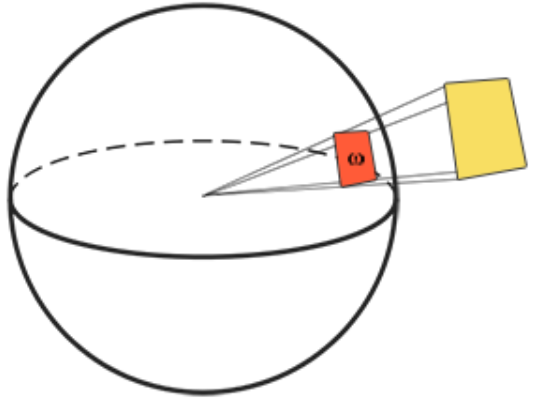

其中,R为相机右轴,U为相机上轴,D为摄像机方向向量(相反,由原点指向相机),P为摄像机位置。

GLM提供了快速创建LookAt矩阵的方法。

glm::mat4 view;

view = glm::lookAt(glm::vec3(0.0f, 0.0f, 3.0f), //参数一:摄像机位置

glm::vec3(0.0f, 0.0f, 0.0f), //参数二:目标位置

glm::vec3(0.0f, 1.0f, 0.0f)); //参数三:世界空间的上向量。

一般,我们会把三个参数以全局变量的形式定义。

glm::vec3 cameraPos = glm::vec3(0.0f, 0.0f, 3.0f);

glm::vec3 cameraFront = glm::vec3(0.0f, 0.0f, -1.0f);

glm::vec3 cameraUp = glm::vec3(0.0f, 1.0f, 0.0f);

view = glm::lookAt(cameraPos, cameraPos + cameraFront, cameraUp);

对于任何仅表示方向的向量,都应该做正交化处理。

Deltatime¶

Deltatime变量存储了渲染上一帧需要的时间。将该变量引入移动速度的计算,就可以做到每帧的移动速度在各种设备上相对平衡。

float currentFrame = glfwGetTime();

deltaTime = currentFrame - lastFrame;

lastFrame = currentFrame;

视角旋转¶

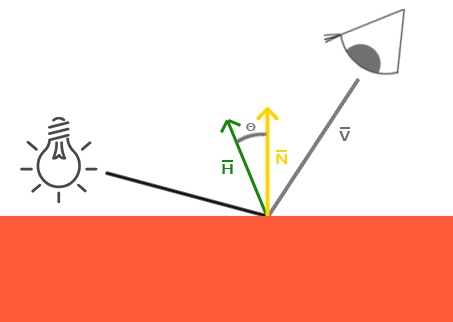

欧拉角分为三种:

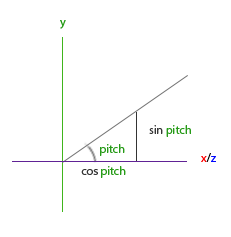

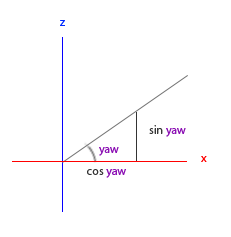

- 俯仰角(Pitch):如何往上或往下看的角,绕x轴旋转。

- 偏航角(Yaw):往左和往右看的程度,绕y轴旋转。

- 滚转角(Roll):翻滚摄像机的程序,绕z轴旋转。

在Unity和其他引擎中,一般不关心滚转角。

direction.x = cos(glm::radians(pitch)) * cos(glm::radians(yaw)); // 译注:direction代表摄像机的前轴(Front),这个前轴是和本文第一幅图片的第二个摄像机的方向向量是相反的

direction.y = sin(glm::radians(pitch));

direction.z = cos(glm::radians(pitch)) * sin(glm::radians(yaw));

理解上面的算法:

在x/z平面,可以计算水平距离和垂直距离。水平距离是cos(pitch),垂直距离(即最终的y分量)是sin(pitch)。

完成水平距离计算后,还要计算x分量和z分量。从上往下看x/z平面:

可以知道x分量是cos(yaw),z分量是sin(yaw)

对于鼠标输入,其水平移动影响Yaw角,竖直移动影响Pitch角。通过计算每一帧鼠标在垂直和水平方向与上一帧的插值,就可以得到具体的pitch和raw角。

glfwSetInputMode(window, GLFW_CURSOR, GLFW_CURSOR_DISABLED)让当前拥有焦点的窗口隐藏并捕捉鼠标。

捕捉(Capture)意味着,无论鼠标如何移动,都不会离开窗口范围。

定义鼠标移动回调函数:void mouse_callback(GLFWwindow* window, double xpos, double ypos),并将其注册到glfwSetCursorPosCallback(window, mouse_callback)。

void mouse_callback(GLFWwindow* window, double xpos, double ypos)

{

//判断鼠标是否第一次进入窗口。如果不设置,会发生鼠标第一次进入窗口时突然跳一下的情况。

if(firstMouse)

{

lastX = xpos;

lastY = ypos;

firstMouse = false;

}

//计算鼠标x、y方向的增量

float xoffset = xpos - lastX;

//注意:这里要反过来加,否则是空战游戏的操作模式。

float yoffset = lastY - ypos;

lastX = xpos;

lastY = ypos;

//灵敏度配置

float sensitivity = 0.05;

xoffset *= sensitivity;

yoffset *= sensitivity;

yaw += xoffset;

pitch += yoffset;

//限制pitch,防止视角偏转。空战类游戏可能不需要限制

if(pitch > 89.0f)

pitch = 89.0f;

if(pitch < -89.0f)

pitch = -89.0f;

//根据三角学原理,修改相机朝向。要注意弧度角度转换

glm::vec3 front;

front.x = cos(glm::radians(yaw)) * cos(glm::radians(pitch));

front.y = sin(glm::radians(pitch));

front.z = sin(glm::radians(yaw)) * cos(glm::radians(pitch));

cameraFront = glm::normalize(front);

}

视角缩放¶

缩放作用于FOV,FOV是投影矩阵范畴的概念,所以缩放是改变的投影矩阵。

void scroll_callback(GLFWwindow* window, double xoffset, double yoffset)

{

if(fov >= 1.0f && fov <= 45.0f)

fov -= yoffset;

if(fov <= 1.0f)

fov = 1.0f;

if(fov >= 45.0f)

fov = 45.0f;

}

projection = glm::perspective(glm::radians(fov), 800.0f / 600.0f, 0.1f, 100.0f);

glfwSetScrollCallback(window, scroll_callback);

手动计算¶

glm::mat4 GetViewMatrix()

{

// 重新计算摄像机的 Right 和 Up 向量

Right = glm::normalize(glm::cross(Front, WorldUp));

Up = glm::normalize(glm::cross(Right, Front));

// 计算LookAt矩阵

glm::mat4 rotation(1.0f);

rotation[0][0] = Right.x;

rotation[1][0] = Right.y;

rotation[2][0] = Right.z;

rotation[0][1] = Up.x;

rotation[1][1] = Up.y;

rotation[2][1] = Up.z;

//负的是因为,实际上变的是物体而不是摄像机

rotation[0][2] = -Front.x;

rotation[1][2] = -Front.y;

rotation[2][2] = -Front.z;

glm::mat4 translation(1.0f);

translation[3][0] = -Position.x;

translation[3][1] = -Position.y;

translation[3][2] = -Position.z;

return rotation * translation;

}

知识点¶

- 相机空间的施密特正交化:相机位置、方向向量(目标指向相机)、右轴、上轴

- LookAt矩阵与观察矩阵:

view = glm::lookAt(cameraPos, cameraPos + cameraFront, cameraUp) - 此处

cameraFront为相机指向目标的向量 - Deltatime控制速度

direction.x = cos(glm::radians(pitch)) * cos(glm::radians(yaw));

direction.y = sin(glm::radians(pitch));

direction.z = cos(glm::radians(pitch)) * sin(glm::radians(yaw));

- 鼠标输入

glfwSetInputMode(window, GLFW_CURSOR, GLFW_CURSOR_DISABLED)glfwSetCursorPosCallback(window, mouse_callback)pitch角的限制,注意弧度转换- 初次鼠标进入时的判断

- 滚轮、FOV与投影矩阵

复习¶

- OpenGL: 一个定义了函数布局和输出的图形API的正式规范。

除OpenGL外,还有DirectX 11,DirectX 12,Metal,Vulkan等图形API。在教程中,我们使用的OpenGL版本是3.3。

我们使用GLFW管理窗口相关的API。

- GLAD: 一个扩展加载库,用来为我们加载并设定所有OpenGL函数指针,从而让我们能够使用所有(现代)OpenGL函数。

在OpenGL中,所有函数都是运行时动态确定的,因此,IDE没办法给我们提供编译时语法检查和代码补全。为了解决这一问题,我们引入GLAD库,让上述功能成为可能。

gladLoadGLLoader((GLADloadproc)glfwGetProcAddress)用来加载所有OpenGL函数指针。

- 视口(Viewport): 我们需要渲染的窗口。

视口与窗口是不同的概念。视口指的是渲染范围,是最终裁剪变换处理的区域。使用glViewport(x,y,width,height)初始化并配置视口。

- 图形管线(Graphics Pipeline): 一个顶点在呈现为像素之前经过的全部过程。

基本的图形管线可以定义为:顶点数据->顶点着色器->几何着色器->形状装配->光栅化->片段着色器->测试与混合->输出

- 着色器(Shader): 一个运行在显卡上的小型程序。很多阶段的图形管道都可以使用自定义的着色器来代替原有的功能。

- 标准化设备坐标(Normalized Device Coordinates, NDC): 顶点在通过在剪裁坐标系中剪裁与透视除法后最终呈现在的坐标系。所有位置在NDC下-1.0到1.0的顶点将不会被丢弃并且可见。

经过顶点着色器处理的坐标必定处于NDC范围内。

- 顶点缓冲对象(Vertex Buffer Object): 一个调用显存并存储所有顶点数据供显卡使用的缓冲对象。

glDrawArray函数直接使用VBO内的数据进行绘制。

- 顶点数组对象(Vertex Array Object): 存储缓冲区和顶点属性状态

在不使用VAO时,我们每次想绘制一个物体,都需要手动绑定对应的VBO,设置顶点属性指针。

VAO可以把这些操作保存,并生成一个VAO对象。之后每次想要绘制这个物体,绑定对应的VAO即可。

- 元素缓冲对象(Element Buffer Object,EBO),也叫索引缓冲对象(Index Buffer Object,IBO): 一个存储元素索引供索引化绘制使用的缓冲对象。

通常,输入的顶点数据不会包含重复的顶点。但对于一些图元来说,它们是共用顶点的。为了简化输入顶点数据,我们使用EBO记录绘制对象所使用的顶点序号。

- Uniform: 一个特殊类型的GLSL变量。它是全局的(在一个着色器程序中每一个着色器都能够访问uniform变量),并且只需要被设定一次。

使用glUniformnx(Location, value)向某着色器的某个uniform传递值。

location使用glGetUniformLocation(shaderProgram, nameofuniform)获取。

n代表参数个数,x代表数据类型,可以是fv(float数组)、4i(ivec4)等。

向Uniform传值之前,对应的着色器程序必须被use。

- 纹理(Texture): 一种包裹着物体的特殊类型图像,给物体精细的视觉效果。

glGenTexture(cnt, addr)用于创建纹理对象。

glBindTexture(GL_TEXTURE_2D, textureObj)用于绑定对象到纹理上下文。

glTexParameteri(GL_TEXTURE_2D,GL_TEXTURE_X,GL_X)用于设置纹理参数。参数有GL_TEXTURE_WARP和GL_TEXTURE_MIN_FILTER等。

glTexImage2D(GL_TEXTURE_2D,0,IMAGETYPE,width,height,0,IMAGETYPE,GL_UNSIGNED_BYTE,data)用于将纹理数据载入上下文。

glGenerateMipmap(GL_TEXTURE_2D)用于生成当前上下文存储纹理的多级渐远纹理。

glActiveTexture(GL_TEXTUREX)用于激活X号纹理单元。类似于,让GL_TEXTURE_2D目标换到X号槽。

Active操作以后要Bind。

-

纹理环绕(Texture Wrapping): 定义了一种当纹理顶点超出范围(0, 1)时指定OpenGL如何采样纹理的模式。

-

纹理过滤(Texture Filtering): 定义了一种当有多种纹素选择时指定OpenGL如何采样纹理的模式。这通常在纹理被放大情况下发生。

- 多级渐远纹理(Mipmaps): 被存储的材质的一些缩小版本,根据距观察者的距离会使用材质的合适大小。

- stb_image.h: 图像加载库。

stbi_load(path, &width, &height,&channels,0)

- 纹理单元(Texture Units): 通过绑定纹理到不同纹理单元从而允许多个纹理在同一对象上渲染。

- 向量(Vector): 一个定义了在空间中方向和/或位置的数学实体。

- 矩阵(Matrix): 一个矩形阵列的数学表达式。

- GLM: 一个为OpenGL打造的数学库。

- 局部空间(Local Space): 一个物体的初始空间。所有的坐标都是相对于物体的原点的。

局部空间类似于Unity的Transform属性的参数。

-

世界空间(World Space): 所有的坐标都相对于全局原点。

-

观察空间(View Space): 所有的坐标都是从摄像机的视角观察的。

- 裁剪空间(Clip Space): 所有的坐标都是从摄像机视角观察的,但是该空间应用了投影。这个空间应该是一个顶点坐标最终的空间,作为顶点着色器的输出。OpenGL负责处理剩下的事情(裁剪/透视除法)。

- 屏幕空间(Screen Space): 所有的坐标都由屏幕视角来观察。坐标的范围是从0到屏幕的宽/高。

- LookAt矩阵: 一种特殊类型的观察矩阵,它创建了一个坐标系,其中所有坐标都根据从一个位置正在观察目标的用户旋转或者平移。

- 欧拉角(Euler Angles): 被定义为偏航角(Yaw),俯仰角(Pitch),和滚转角(Roll)从而允许我们通过这三个值构造任何3D方向。

CMake与ImGui¶

设置 CMake 最低版本和项目名称¶

cmake_minimum_required(VERSION 3.28)

project(LearnOpenGL)

cmake_minimum_required(VERSION 3.28):这行代码指定了我们希望使用的最低 CMake 版本是 3.28。project(LearnOpenGL):这行代码将我们的项目命名为 "LearnOpenGL"。

设置 C++ 标准¶

为了确保代码能够使用特定的 C++ 标准,我们需要明确指定它:

set(CMAKE_CXX_STANDARD 17)

set(CMAKE_CXX_STANDARD 17):这行代码将 C++ 标准设置为 C++17。这样可以确保我们的代码能够使用 C++17 的特性,同时也能确保编译器正确处理这些特性。

手动设置 GLFW 路径¶

由于我们使用的是本地安装的 GLFW 库,因此需要手动设置其包含目录和库目录:

set(GLFW_INCLUDE_DIR "${CMAKE_SOURCE_DIR}/include/GLFW")

set(GLFW_LIB_DIR "${CMAKE_SOURCE_DIR}/libs")

set(GLFW_LIBRARY "${CMAKE_SOURCE_DIR}/libs/glfw3.dll")

set(GLFW_INCLUDE_DIR "C:/Users/msik/CLionProjects/LearnOpenGL/include/GLFW"):设置 GLFW 的包含目录路径,使编译器能够找到 GLFW 的头文件。set(GLFW_LIB_DIR "C:/Users/msik/CLionProjects/LearnOpenGL/libs"):设置 GLFW 的库目录路径。set(GLFW_LIBRARY "C:/Users/msik/CLionProjects/LearnOpenGL/libs/glfw3.dll"):设置 GLFW 的库文件路径。

${CMAKE_SOURCE_DIR}是内置宏,指CMakeList.txt所在的目录。

添加 IMGUI 库¶

IMGUI 是一个常用的图形用户界面库。我们需要将其添加到我们的项目中:

add_library(IMGUI SHARED

./imgui/imgui.cpp

./imgui/imgui_impl_glfw.cpp

./imgui/imgui_impl_opengl3.cpp

./imgui/imgui_draw.cpp

./imgui/imgui_tables.cpp

./imgui/imgui_widgets.cpp

./imgui/imgui_demo.cpp

./imgui/imgui_stdlib.cpp

)

add_library(IMGUI SHARED ...):这行代码定义了一个共享库,名为IMGUI,并包含了多个源文件。共享库可以在多个程序之间共享,提高了代码复用性。

接下来设置 IMGUI 库的包含目录和链接库:

target_include_directories(IMGUI PRIVATE ${GLFW_INCLUDE_DIR})

target_link_libraries(IMGUI PRIVATE ${GLFW_LIBRARY})

target_include_directories(IMGUI PRIVATE ${GLFW_INCLUDE_DIR}):将 GLFW 的包含目录添加到 IMGUI 库的私有包含目录中,确保 IMGUI 库可以访问 GLFW 的头文件。target_link_libraries(IMGUI PRIVATE ${GLFW_LIBRARY}):将 GLFW 库文件链接到 IMGUI 库中,使 IMGUI 库能够使用 GLFW 的功能。

添加可执行文件¶

接下来,我们为项目添加一个可执行文件:

add_executable(LearnOpenGL

Archive/main.cpp

glad.c

include/shader_s.h

GLMTest.cpp

stbitmp.cpp

include/camera.h

)

add_executable(LearnOpenGL ...):这行代码定义了一个可执行文件,名为LearnOpenGL,并指定了其源文件列表。可执行文件是最终生成的程序,可以运行。

包含路径¶

我们需要指定包含目录,以便编译器能够找到所有头文件:

include_directories(${GLFW_INCLUDE_DIR} "${CMAKE_SOURCE_DIR}/include")

include_directories(...):这行代码将 GLFW 的包含目录和项目的包含目录添加到编译器的搜索路径中,使编译器能够找到这些头文件。

链接库¶

最后,我们需要将所有必要的库链接到可执行文件中:

target_link_libraries(LearnOpenGL PRIVATE ${GLFW_LIBRARY} IMGUI)

target_link_libraries(LearnOpenGL PRIVATE ${GLFW_LIBRARY} IMGUI):这行代码将 GLFW 库和 IMGUI 库链接到LearnOpenGL可执行文件中,使其能够使用这些库的功能。

与OpenGL工程集成¶

- 添加头文件

#include "imgui.h"

#include "imgui_impl_glfw.h"

#include "imgui_impl_opengl3.h"

- 初始化

IMGUI_CHECKVERSION(); //检查版本

ImGui::CreateContext(); //创建上下文

ImGuiIO& io = ImGui::GetIO();

io.ConfigFlags |= ImGuiConfigFlags_NavEnableKeyboard; //激活键盘支持

ImGui_ImplGlfw_InitForOpenGL(window, true); //在GLFW窗口上进行初始化

ImGui_ImplOpenGL3_Init();

- 每次渲染初始化

ImGui_ImplOpenGL3_NewFrame();

ImGui_ImplGlfw_NewFrame();

ImGui::NewFrame();

if(ImGui::Begin("窗口名")){

//窗口控件逻辑放在这

//..

ImGui::End();

}

- 每次渲染结束

ImGui::Render();

ImGui_ImplOpenGL3_RenderDrawData(ImGui::GetDrawData());

- 程序终止

ImGui_ImplOpenGL3_Shutdown();

ImGui_ImplGlfw_Shutdown();

ImGui::DestroyContext();

控件¶

文本¶

| 变体函数 | 作用描述 | 示例代码 |

|---|---|---|

ImGui::Text |

显示简单文本 | ImGui::Text("This is some useful text."); |

ImGui::TextColored |

显示带颜色的文本 | ImVec4 color = ImVec4(1.0f, 0.0f, 0.0f, 1.0f);ImGui::TextColored(color, "This is red text."); |

ImGui::TextDisabled |

显示灰色文本,表示禁用状态 | ImGui::TextDisabled("This is disabled text."); |

ImGui::TextWrapped |

显示自动换行的文本 | ImGui::TextWrapped("This is some long text that will automatically wrap."); |

ImGui::TextUnformatted |

显示不进行格式化的文本 | const char* text = "This is unformatted text.";ImGui::TextUnformatted(text); |

ImGui::Text (格式化字符串) |

使用格式化字符串显示文本 | int value = 42;ImGui::Text("The answer is %d", value); |

按钮¶

| 控件函数 | 作用描述 | 示例代码 |

|---|---|---|

ImGui::Button |

创建一个按钮 | if (ImGui::Button("Click Me")) { /* 按钮被点击时执行的代码 */ } |

ImGui::SmallButton |

创建一个小按钮 | if (ImGui::SmallButton("Click Me")) { /* 小按钮被点击时执行的代码 */ } |

ImGui::InvisibleButton |

创建一个不可见的按钮 | if (ImGui::InvisibleButton("Click Me", ImVec2(100, 20))) { /* 按钮被点击时执行的代码 */ } |

复选框¶

| 控件函数 | 作用描述 | 示例代码 |

|---|---|---|

ImGui::Checkbox |

创建一个复选框 | static bool checked = false;ImGui::Checkbox("Check Me", &checked); |

ImGui::CheckboxFlags |

创建一个带有标志的复选框 | static int flags = 0;ImGui::CheckboxFlags("Flag 1", &flags, 1); |

输入框¶

| 控件函数 | 作用描述 | 示例代码 |

|---|---|---|

ImGui::InputText |

创建一个文本输入框 | static char text[128] = "";ImGui::InputText("Input Text", text, IM_ARRAYSIZE(text)); |

ImGui::InputTextMultiline |

创建一个多行文本输入框 | static char text[128] = "";ImGui::InputTextMultiline("Input Text", text, IM_ARRAYSIZE(text)); |

ImGui::InputInt |

创建一个整数输入框 | static int value = 0;ImGui::InputInt("Input Int", &value); |

ImGui::InputFloat |

创建一个浮点数输入框 | static float value = 0.0f;ImGui::InputFloat("Input Float", &value); |

滑块¶

| 控件函数 | 作用描述 | 示例代码 |

|---|---|---|

ImGui::SliderFloat |

创建一个浮点数滑块 | static float value = 0.0f;ImGui::SliderFloat("Float Slider", &value, 0.0f, 1.0f); |

ImGui::SliderInt |

创建一个整数滑块 | static int value = 0;ImGui::SliderInt("Int Slider", &value, 0, 100); |

ImGui::VSliderFloat |

创建一个垂直浮点数滑块 | static float value = 0.0f;ImGui::VSliderFloat("VFloat Slider", ImVec2(20,100), &value, 0.0f, 1.0f); |

ImGui::VSliderInt |

创建一个垂直整数滑块 | static int value = 0;ImGui::VSliderInt("VInt Slider", ImVec2(20,100), &value, 0, 100); |

下拉框¶

| 控件函数 | 作用描述 | 示例代码 |

|---|---|---|

ImGui::Combo |

创建一个下拉框 | static int item = 0;const char* items[] = { "Item 1", "Item 2", "Item 3" };ImGui::Combo("Combo", &item, items, IM_ARRAYSIZE(items)); |

光照¶

颜色¶

颜色可以数字化的由红色(Red)、绿色(Green)和蓝色(Blue)三个分量组成,它们通常被缩写为RGB。

glm中,使用glm::vec3 COLOR_NAME(float x, float y, float z)定义颜色变量。

现实中,我们看到物体的颜色实际上是被物体反射(即无法被物体吸收)的颜色与光源颜色的叠加。因此,要计算最终我们看到物体的颜色,可以用光源颜色*物体颜色的方式得到最终的颜色项链。

glm::vec3 lightColor(1.0f, 1.0f, 1.0f);

glm::vec3 toyColor(1.0f, 0.5f, 0.31f);

glm::vec3 result = lightColor * toyColor; // = (1.0f, 0.5f, 0.31f);

严谨的物体颜色定义应为:物体从一个光源反射各个颜色分量的大小。考虑如下光源和物体:

glm::vec3 lightColor(0.0f, 1.0f, 0.0f);

glm::vec3 toyColor(1.0f, 0.5f, 0.31f);

可以得出,物体在反射光源颜色时,R和B通道压根就没有颜色给它反射。而G通道可以反射一半,最终得到颜色(0.0f, 0.5f, 0.0f),即深绿色。

当两个物体使用不同材质时,需要创建两个不同的Shader对象。

注意:

绘制应用不同Shader的对象时,需要use()。

同时,也需要设置新Shader的View和Projection矩阵。

基础光照¶

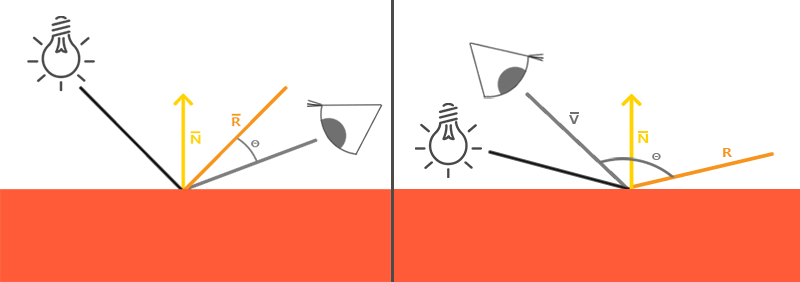

冯氏光照模型(Phong Lighting Model)是一种简单的光照模型。它分为三个部分:

- 环境光(Ambient):在任何情况下都给予物体的颜色。

- 漫反射光(Diffuse):模拟光源对物体的方向性影响。物体的某部分越正对光源,就越亮。

- 高光(Specular):有光泽表面上出现的亮点,其颜色更加接近于光照颜色本身。

环境光¶

全局光照(Global Illumination,GI)是考虑到间接光照的算法。环境光是一种极其简化的全局光照方式。其实现方式如下:

float ambientStrength = 0.1; //环境光强度,其值通常很小

vec3 ambient = ambientStrength * lightColor; //环境光色

vec3 result = ambient * objectColor; //叠加物体本身颜色

FragColor = vec4(result, 1.0);

漫反射光¶

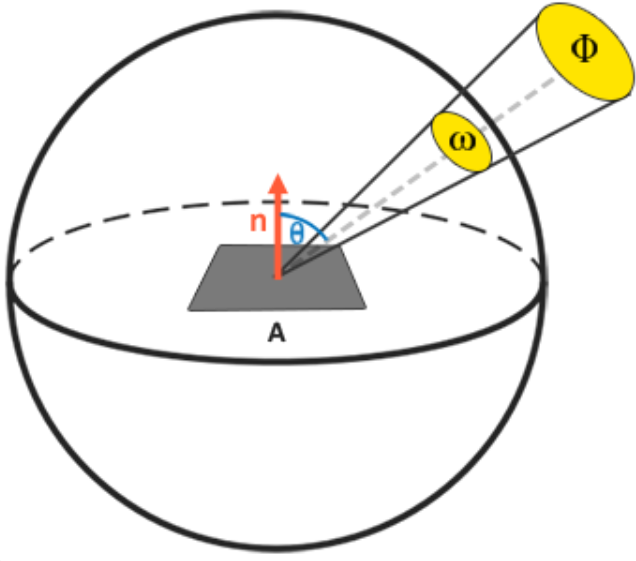

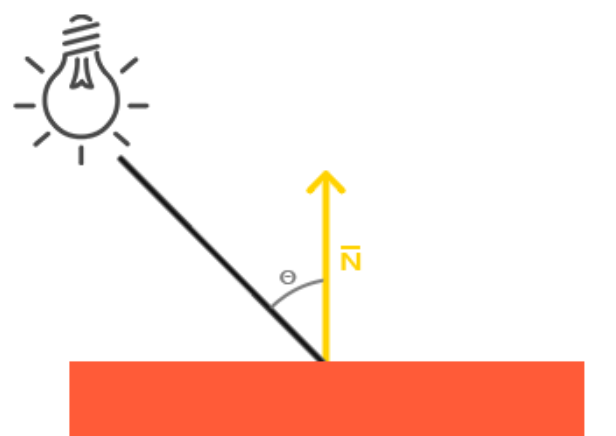

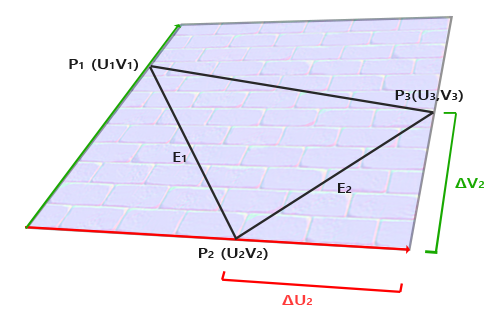

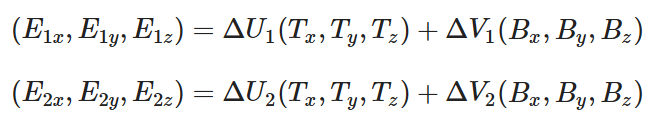

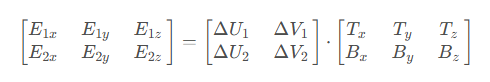

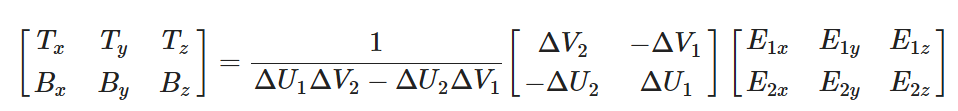

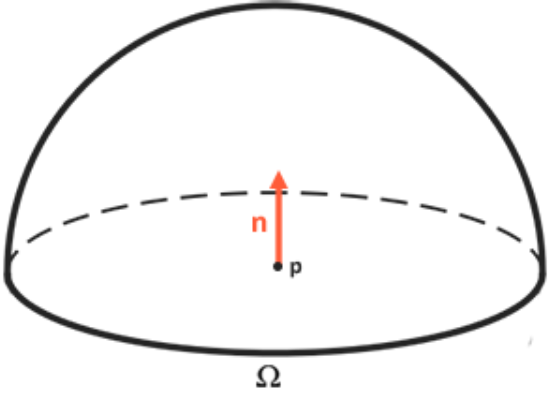

法向量(Normal Vector)是垂直于片段表面的向量。法向量一般存储在顶点数据里,作为一个顶点属性。

两个单位向量的夹角越小,它们点乘的结果越倾向于1。借助这一点,实现漫反射效果,即:越正对光源,颜色越亮。

这个算法需要获取两个数据:光照方向和法向量。前者通过使用uniform向着色器传递lightPos获得,后者通过顶点属性配置获得。

任何不涉及距离,只涉及方向的向量与计算都应当归一化

vec3 normal = normalize(norm);

vec3 lightDir = normalize(lightPos-fragWorldPos);

float diffuseStrength = max(dot(normal,lightDir),0.0); //防止得到负数

vec3 diffuse = diffuseStrength*lightColor;

vec3 ambient = ambientStrength*lightColor;

FragColor = vec4((ambient+diffuse)*objectColor,1.0f); //相加而非相乘

传入的法向量是基于局部坐标的。法向量不能简单地通过乘以模型矩阵变换,因为这些变换会破坏发现的垂直性质。

法线矩阵(Normal Matrix)是专门将法向量变换到世界坐标的矩阵。它是模型矩阵左上叫3x3部分的逆矩阵的法线矩阵。因此,可以使用

Normal = mat3(transpose(inverse(model))) * aNormal来计算世界坐标下的法线。这一操作应当在cpp程序中进行,然后通过uniform传递到着色器,因为矩阵求逆对着色器来说是非常耗时的。

高光¶

高光取决于LightDir、Norm和ViewDir。

如图,入射光和反射光与法线的夹角都是α,ViewDir和反射光的夹角是θ。高光最强的地方就是反射光所在的方向,因此,θ越小,高光越强。因此,同样可以通过点乘来得到高光系数。

//高光计算

vec3 viewDir = normalize(viewPos-fragWorldPos); //viewDir由uniform传入,指相机的世界坐标

vec3 reflectDir = reflect(-lightDir,normal); //reflect函数的参数一是由光源指向物体的方向向量

vec3 specular = pow(max(dot(reflectDir,viewDir),0.0),shineness)*lightColor*specularStrength;//shineness是反光度属性,越大则高光影响范围越大,强度越强

冯氏光照模型的三个部分是相加的。

在顶点着色器中完成的冯氏光照模型角Gouraud着色。它的效果不好,因为其颜色由插值决定。

代码¶

世界空间下¶

float ambientStrength = 0.1f;

float specularStrength = 0.5f;

int shineness = 32;

while(!glfwWindowShouldClose(window)) {

process_keyboard_input(window);

glClearColor(0.2f,0.3f,0.4f,1.0f);

glClear(GL_COLOR_BUFFER_BIT | GL_DEPTH_BUFFER_BIT);

shader.use();

shader.setVec3("viewPos",camera.Position.x,camera.Position.y,camera.Position.z);

//绘制imgui交互窗口

imgui_frame_init();

if(ImGui::Begin("window")){

ImGui::SliderFloat("AmbientStrength",&ambientStrength,0.0f,1.0f);

shader.setFloat("ambientStrength",ambientStrength);

ImGui::SliderFloat("SpecularStrength",&specularStrength,0.0f,1.0f);

shader.setFloat("specularStrength",specularStrength);

ImGui::SliderInt("Shineness",&shineness,2,256);

shader.setInt("shineness",shineness);

ImGui::SliderFloat3("LightPos",glm::value_ptr(lightPos),-3.0f,3.0f);

ImGui::Checkbox("canViewRotate(K to switch)",&canMove);

ImGui::End();

}

float currFrame=glfwGetTime();

deltaTime = currFrame-lastFrame;

lastFrame = currFrame;

//变换

glm::mat4 view = camera.GetViewMatrix();

glm::mat4 proj = glm::perspective(glm::radians(camera.Zoom), (float)SCR_WIDTH / (float)SCR_HEIGHT, 0.1f, 100.0f);

shader.setMat4("view",view);

shader.setMat4("proj",proj);

//绘制物体

glBindVertexArray(VAO);

glm::mat4 model = glm::mat4(1.0f);

shader.setMat4("model", model);

shader.setVec3("lightPos",lightPos.x,lightPos.y,lightPos.z);

glDrawArrays(GL_TRIANGLES, 0, 36);

//绘制光源

glBindVertexArray(lightVAO);

lightShader.use();

lightShader.setMat4("view",view);

lightShader.setMat4("proj",proj);

model = glm::translate(model,lightPos);

model = glm::scale(model,glm::vec3(0.5f));

lightShader.setMat4("model", model);

glDrawArrays(GL_TRIANGLES, 0, 36);

imgui_end_draw();

//收尾操作

glfwSwapBuffers(window);

glfwPollEvents();

}

#version 330 core

out vec4 FragColor;

in vec3 norm;

in vec3 fragWorldPos;

uniform vec3 objectColor;

uniform vec3 lightColor;

uniform float ambientStrength;

uniform float specularStrength;

uniform int shineness;

uniform vec3 lightPos;

uniform vec3 viewPos;

void main() {

//漫反射光计算

vec3 normal = normalize(norm);

vec3 lightDir = normalize(lightPos-fragWorldPos);

float diffuseStrength = max(dot(normal,lightDir),0.0);

vec3 diffuse = diffuseStrength*lightColor;

//环境光计算

vec3 ambient = ambientStrength*lightColor;

//高光计算

vec3 viewDir = normalize(viewPos-fragWorldPos);

vec3 reflectDir = reflect(-lightDir,normal);

vec3 specular = pow(max(dot(reflectDir,viewDir),0.0),shineness)*lightColor*specularStrength;

FragColor = vec4((ambient+diffuse+specular)*objectColor,1.0f);

}

#version 330 core

layout (location = 0) in vec3 aPos;

layout (location = 1) in vec3 aNorm;

uniform mat4 model;

uniform mat4 view;

uniform mat4 proj;

out vec3 norm;

out vec3 fragWorldPos;

void main()

{

gl_Position = proj * view * model * vec4(aPos, 1.0);

fragWorldPos = (model*vec4(aPos,1.0f)).xyz;

norm = aNorm;

}

观察空间下¶

#version 330 core

out vec4 FragColor;

in vec3 norm;

in vec3 fragViewPos;

in vec3 lightViewPos;

uniform vec3 objectColor;

uniform vec3 lightColor;

uniform float ambientStrength;

uniform float specularStrength;

uniform int shineness;

void main() {

//漫反射光计算

vec3 normal = normalize(norm);

vec3 lightDir = normalize(lightViewPos-fragViewPos);

float diffuseStrength = max(dot(normal,lightDir),0.0);

vec3 diffuse = diffuseStrength*lightColor;

//环境光计算

vec3 ambient = ambientStrength*lightColor;

//高光计算

vec3 viewDir = normalize(-fragViewPos);

vec3 reflectDir = reflect(-lightDir,normal);

vec3 specular = pow(max(dot(reflectDir,viewDir),0.0),shineness)*lightColor*specularStrength;

FragColor = vec4((ambient+diffuse+specular)*objectColor,1.0f);

}

#version 330 core

layout (location = 0) in vec3 aPos;

layout (location = 1) in vec3 aNorm;

uniform mat4 model;

uniform mat4 view;

uniform mat4 proj;

uniform vec3 lightPos;

out vec3 norm;

out vec3 fragViewPos;

out vec3 lightViewPos;

void main()

{

gl_Position = proj * view * model * vec4(aPos, 1.0);

fragViewPos = (view*model*vec4(aPos,1.0f)).xyz;

lightViewPos = (view*vec4(lightPos,1.0f)).xyz;

norm = mat3(transpose(inverse(view * model)))*aNorm; //关键在于使用法线矩阵变换法线位置

}

材质¶

在通常的着色器编写中,并不是直接使用 objectColor 计算表面颜色的,而是使用材质(Material)。材质定义了物体表面的反射特性,包含环境光、漫反射率和镜面反射率等属性。

与 C 语言类似,OpenGL 也可以定义结构体来组织数据。以下示例展示了如何在 GLSL 中定义一个 Material 结构体,并将其用作 uniform 变量:

#version 330 core

struct Material {

vec3 ambient;

vec3 diffuse;

vec3 specular;

float shininess;

};

uniform Material material;

环境光¶

ambient 材质向量定义了在环境光照下,这个表面反射的颜色。环境光通常是模拟全局光照的,它在所有方向上均匀地影响物体的每个部分。ambient 通常设置为表面的基础颜色,以确保即使在阴影中物体也能被轻微看到。

漫反射¶

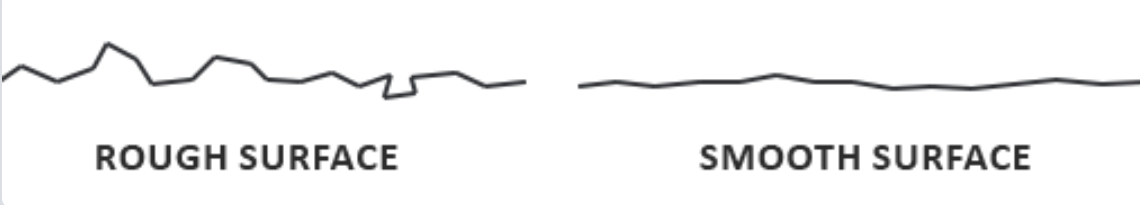

diffuse 材质向量定义了表面的漫反射颜色。漫反射模拟了光在粗糙表面上的扩散反射,使光在多个方向上散射。漫反射颜色设置为期望的物体颜色,因为它直接影响物体在被光照射时的可见颜色。

镜面反射¶

specular 材质向量设置了表面的镜面反射颜色。它决定了光在表面上的镜面高光颜色。这种反射通常用于模拟光滑表面的光泽度或闪亮效果。高光的颜色可以是白色的(表示强光反射),也可以是其他颜色,具体取决于表面材料的特性。

镜面反射度¶

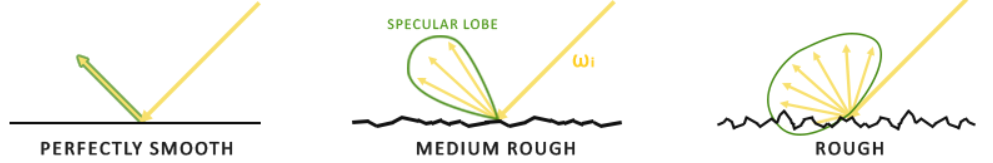

shininess 参数影响镜面高光的散射程度或半径。较高的 shininess 值会使高光更加集中和尖锐,模拟光滑或抛光的表面;较低的 shininess 值会使高光更加扩散和柔和,模拟粗糙的表面。

材质属性的设置需要丰富的实践。

光源¶

通常来说,物体对于环境光、漫反射光和高光的反射力度是不同的。材质描述了物体在反射这三类光时的颜色属性,而反射力度是另一种截然不同的属性。

struct Light {

vec3 position;

vec3 ambient; //环境光影响系数

vec3 diffuse; //漫反射率

vec3 specular; //镜面反射率

};

uniform Light light;

一般,环境光的反射力度较小,在0.1f左右。漫反射可以在0.5f-0.7f左右,而高光一般都为1.0f。

我该如何理解漫反射、镜面反射率?

与漫反射颜色不同,漫反射率是指物体对漫反射颜色中R、G、B分量的反射程度。

假设漫反射率为(0.2f, 0.3f, 0.4f),那么,漫反射颜色中,有20%的红色能被漫反射到观察者视角中,30%的绿色以及40%的红色同理。

镜面反射率也是如此。镜面反射率通常被设置为(1.0f, 1.0f, 1.0f),因为镜面反射一般直接反映出光源的颜色。

光照贴图¶

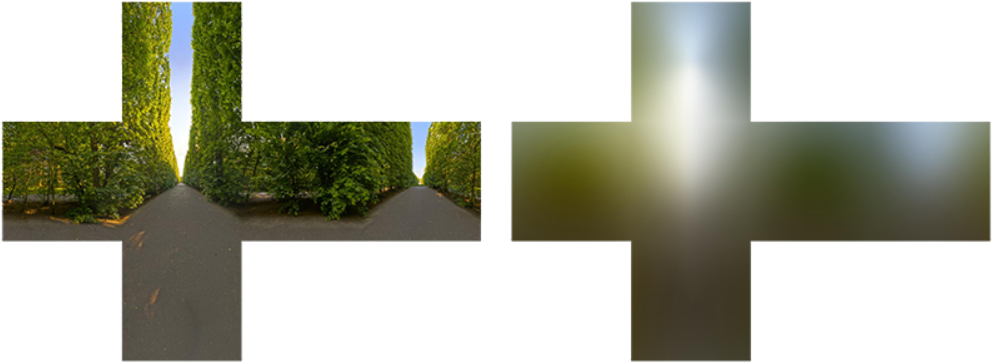

之前,我们对材质三个光照分类的控制,是使用传入uniform来实现的。但实际上,我们经常会遇到一个物体的不同部分是不同材质的情况。为了处理这种情况,我们引入光照贴图(Map)的概念,对材质的不同区域设置不同的光照分量强度。

贴图,类似于纹理,也是一种覆盖物体的图像。它允许着色器逐片段索引其中的颜色值。

和纹理一样,在着色器内使用sampler2D类型定义采样器,并使用texture(sampler2D tex, vec2 uv)函数采样。

漫反射贴图¶

漫反射贴图(Diffuse Map)可以看作是传统光照模型(如Phong、Blinn-Phong)中的Base-Color。它表现了物体本身的颜色。

struct Material {

sampler2D diffuse;

vec3 specular;

float shininess;

};

...

in vec2 TexCoords;

...

vec3 diffuse = light.diffuse * diff * vec3(texture(material.diffuse, TexCoords));

vec3 ambient = vec3(texture(material.diffuse,TexCoords))*lightColor*light.ambient;

这里移除了结构体内的

vec3 ambient属性,因为几乎在所有情况下,环境光颜色都等于漫反射颜色,所以环境光用漫反射贴图进行采样。

高光贴图¶

高光贴图用于控制高光分量。

vec3 specular = specularRatio * lightColor * vec3(texture(material.specular, TexCoords)) * light.specular

投光物¶

将光投射到物体的光源叫做投光物(Light Caster)。

平行光¶

平行光,又称定向光(Directional Light),投射的所有光线都来自于同一方向,与光源的位置无关。

太阳光被视为一种平行光。

对于定向光,其结构体中只需包含一个方向向量和三个光照分量即可。

struct Light {

vec3 direction;

vec3 ambient;

vec3 diffuse;

vec3 specular;

};

#version 330 core

struct Material {

sampler2D diffuse;

sampler2D specular;

float shininess;

};

struct Light {

vec3 direction;

vec3 ambient;

vec3 diffuse;

vec3 specular;

vec3 color;

float strength;

};

uniform Light light;

uniform Material material;

uniform vec3 viewPos;

uniform float time;

in vec3 norm;

in vec3 fragPos;

in vec2 TexCoords;

out vec4 FragColor;

void main() {

// 计算光源方向

vec3 lightDir = normalize(-light.direction);

// 计算环境光

vec3 ambient = vec3(texture(material.diffuse, TexCoords)) * light.ambient;

// 计算漫反射光

vec3 normal = normalize(norm);

float diffuseStrength = max(dot(normal, lightDir), 0.0);

vec3 diffuse = vec3(texture(material.diffuse, TexCoords)) * diffuseStrength * light.diffuse;

// 计算高光

vec3 viewDir = normalize(viewPos - fragPos);

vec3 reflectDir = reflect(-lightDir, normal);

float specularStrength = pow(max(dot(viewDir, reflectDir), 0.0), material.shininess);

vec3 specular = specularStrength * vec3(texture(material.specular, TexCoords)) * light.specular;

// 合并所有光照效果

vec3 result = ambient + diffuse + specular;

// 输出最终颜色

FragColor = vec4(result*light.color*light.strength, 1.0f);

}

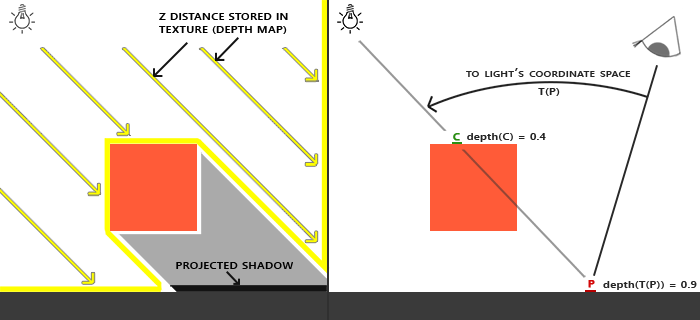

点光源¶

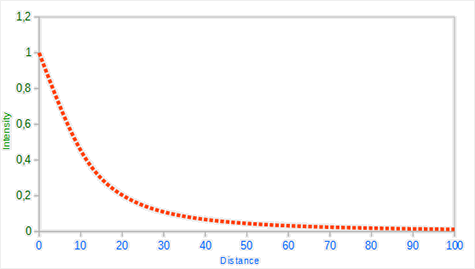

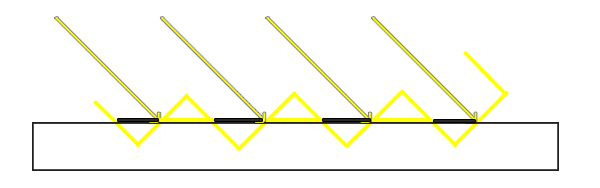

与平行光不同,点光源(Point Light)的光线会随距离衰减(Attenuation)。

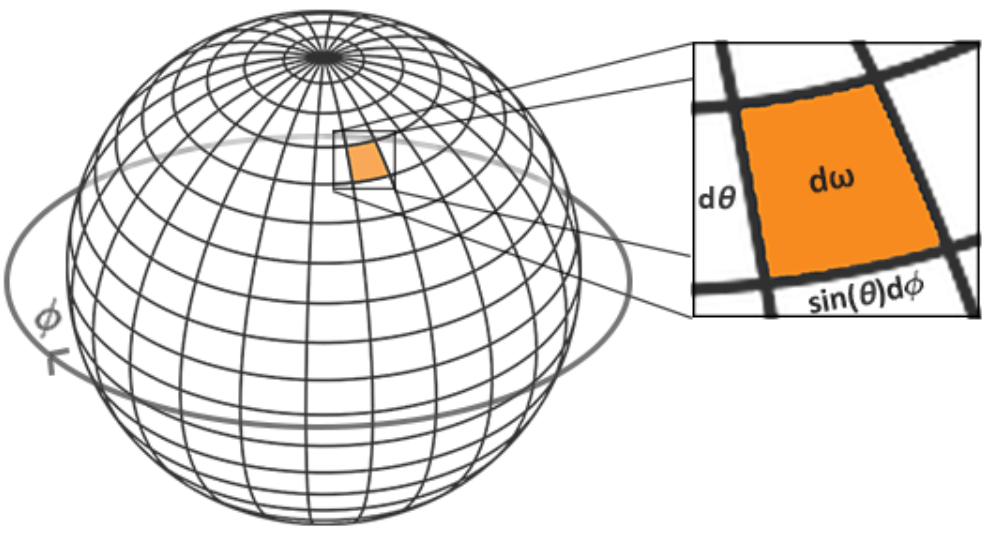

在现实世界中,灯在近处通常会非常亮,但随着距离的增加光源的亮度一开始会下降非常快,但在远处时剩余的光强度就会下降的非常缓慢了。为了模拟这一过程,我们使用下列公式: $$ \begin{equation} F_{att} = \frac{1.0}{K_c + K_l * d + K_q * d^2} \end{equation} $$ 其中,\(F_{att}\)是衰减率,用于乘以光照强度。

\(K_{c}\)是常数项,通常为1.0,用于保证分母大于1,使得衰减率始终随距离增大而减小。

\(K_{l}\)是一次项系数,以线性方式减少强度。

\(K_{q}\)是二次项系数,当距离较大时,二次项的影响会更加显著。。

经过该公式计算的衰减率乘以光强,最终得到的亮度如下:

三个K值的具体值设置需要实践经验。一次项系数越小,光源覆盖的距离越大,二次项系数的变化趋势与一次项系数相同,但它比一次项系数小更多。

| 距离 | 常数项 | 一次项 | 二次项 |

|---|---|---|---|

| 7 | 1.0 | 0.7 | 1.8 |

| 13 | 1.0 | 0.35 | 0.44 |

| 20 | 1.0 | 0.22 | 0.20 |

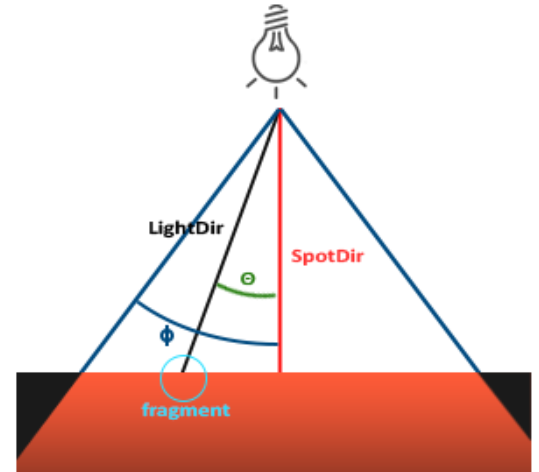

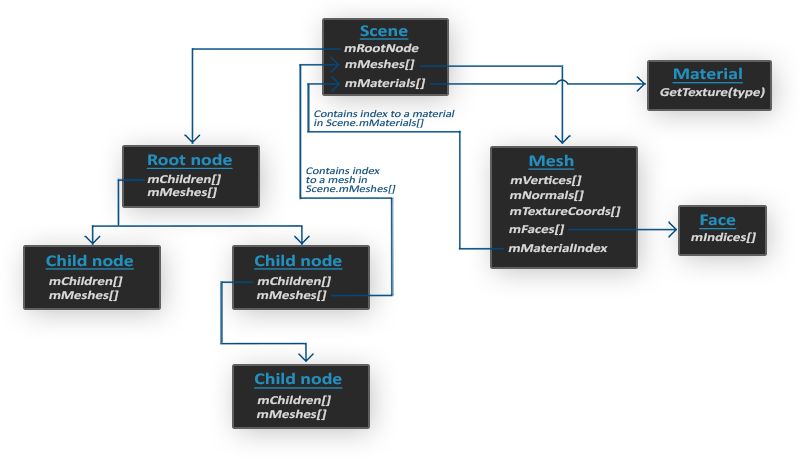

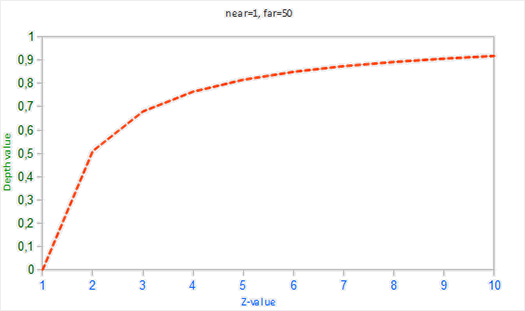

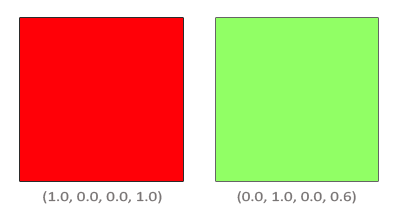

| 32 | 1.0 | 0.14 | 0.07 |